La historia (más conflictiva) del PC: Hardware gráfico, de 3dfx a NVIDIA

Nuestro PC de hoy es el resultado de la competencia, más o menos cruenta, entre distintos personajes, compañías y tecnologías. La máquina que ahora disfrutamos era la apuesta de los que mejor lo han hecho o menos escrúpulos han demostrado, dejando atrás a otras tecnologías que nos hubieran llevado por caminos bien distintos.

- Cuarta parte: De cómo un juego o un fabricante lo cambian todo. De cómo SEGA Dreamcast estuvo a punto de impedir la edad de oro de las aceleradoras 3D. De cómo NVIDIA quebró y prácticamente desapareció. De cómo 14 meses no son suficientes y que para retar a una carrera hace falta ser rápido.

A lo largo de este reportaje hemos narrado cómo el PC que disfrutamos hoy no es sino el vencedor de una dura carrera de eliminación donde esta tecnología y formato han prevalecido, mientras otras muchas alternativas han quedado atrás. Hemos visto un primer conflicto donde la computadora nace entre engranajes, válvulas de vacío y cintas de papel, cómo esa tecnología se va acercando a los hogares y finalmente se normaliza gracias al saber hacer de empresas como IBM, Apple o Microsoft y, finalmente, narramos uno de los conflictos por la prevalencia tecnológica más interesantes que se han dado este siglo, con Steve Jobs como indudable protagonista.

En esta entrega narraremos otro conflicto aún más cercano a todos nosotros y, si cabe, más relacionado con nuestro ocio: los videojuegos. Nos centraremos casi exclusivamente en el hardware gráfico, en cómo se hizo imprescindible en cuestión de meses gracias a la fulgurante ascensión de 3dfx, tan rápida como su caída, para pasar a normalizarse con NVIDIA, que lo devoró todo, excepto a una ATi que aún les sigue dando guerra.

En esta ocasión, contraviniendo cualquier libro de estilo, me voy a permitir la licencia de narrar algunos de los hechos en primera persona. Como responsable de la sección de hardware de Meristation durante dos décadas he tenido la suerte de poder presenciar en primera fila acontecimientos que a continuación se narran, algunos realmente sorprendentes. Espero que este recorrido acompañando al hardware gráfico os parezca igual de interesante que lo ha sido para mí.

Antes de 3dfx

En nuestra segunda entrega vimos con un joven Steven Wozniak integraba un televisor y un teclado a su computadora, con un formato que aún mantenemos hoy. Ese avance no solo suponía una configuración particular de hardware, sino que cambiaba la forma en la que los usuarios nos comunicamos con las computadoras. Desde su creación durante la Segunda Guerra Mundial hasta prácticamente ese momento, los usuarios configuraban una serie de operaciones u otra tarea a la computadora y luego ésta se ponía a trabajar, ofreciendo sus resultados generalmente en tiras de papel perforado. Con el monitor y el teclado el usuario pasó a interactuar directamente con la computadora, usando un interfaz mucho más adaptado al ser humano que las arcaicas tiras de papel.

Antes del Apple I algunas computadoras “mainframe” usaban también monitores para mostrar información, pero además de no considerarse necesario, contaba con el problema de los recursos que esa operación requería, fundamentalmente memoria. Estas limitaciones obligaban a que la imagen mostrada fuese de una resolución muy reducida y monócroma. Recordemos que todas estas computadoras se dirigían al ámbito empresarial, militar y educativo, donde no hacía falta más.

El hardware gráfico era inexistente como tal. Las computadoras únicamente contaban con un adaptador para transformar una señal digital que indicaba el estado de cada pixel en una analógica que supiese interpretar un monitor de rayos catódicos. Básicamente era un DAC (Digital to Analogic Converter) sin otra aspiración gráfica más allá del texto plano.

Hubo que esperar hasta 1981 para que IBM, quién si no, lanzase la primera tarjeta gráfica, un hardware que permitía una resolución máxima de 720x350 monócroma, el clásico fósforo verde. El color llegaría en 1983 de mano de Intel que, por cerca de 1000 dólares, permitía hasta 8 colores en pantalla. Hasta 1987 no contaríamos con tarjetas gráficas que permitían color de 16 bit y una resolución de 800x600, la estándar durante muchos años. Sería ATi con su VGA Wonder, pero resultaba un hardware aún demasiado caro y destinado al uso profesional.

Pero cuando el PC empieza a entrar en las casas, las necesidades cambian. Llegan los años 80 y con ellos las microcomputadoras; los Commodore, Atari, MSX, Amstrad y Spectrum. Pequeñas computadoras que podían alardear de su cantidad de memoria o de su velocidad de proceso, pero que realmente vendían por lo que el comprador veía en pantalla y, como siempre lo ha sido, era importante mostrar muchos colores y gráficos más definidos y rápidos. Se hacía imprescindible contar con un chip gráfico dedicado que descargase de trabajo al procesador central, aunque éste siempre debía encargarse de la mayor parte de las operaciones.

Y, aunque parezca mentira, así nos tiramos una década. Los ordenadores montaban ya una tarjeta gráfica pero pasaban desapercibidas para la mayoría de los jugadores. Sus funciones eran casi en exclusiva 2D y únicamente se exigía algo “especial” para tareas de CAD u otro desempeño profesional. Eran tiempos de Matrox, S3, Hercules y ATi.

Los jugadores pasamos de jugar con el Sinclair ZX Spectrum y el Amstrad CPC, que eran máquinas económicas y “domésticas” a jugar en las consolas de 8 bit, la NES y la Master System. A estas les sucedieron las 16 bit, Super Nintendo y Megadrive. Fueron unos años en los que el ocio electrónico se desplazó de los microordenadores, donde vivimos la gloriosa Edad de Oro del Software Español, con sus juegos de Topo, Erbe, Dinamic y las carátulas de los maestros Azpiri y Royo, para saltar a las consolas.

Por supuesto en los PC también había juegos, algunos de ellos muy buenos, como Maniac Mansion, SimCity, Prince of Persia o Gauntlet, pero la plataforma seguía siendo hostil para los más jóvenes y muy cara para sus padres, con lo que las consolas coparon prácticamente el ocio electrónico. Todo era mejor en las consolas, a excepción de una cosa; el shareware y freeware. En tiempos donde Internet era solo un proyecto, las revistas informáticas en papel tuvieron su correspondiente edad dorada gracias, en gran medida, a los disquetes que regalaban, donde se incluían todo tipo de programas y juegos gratuitos.

Precisamente desde uno de estos medios entran en escena un par de personajes de esos que cambian tendencias; paradigmáticos. Hablamos de Jhon Carmack y Jhon Romero, fundadores de id Software. Ambos colaboraban con la revista Softdisk, un curioso proyecto que desde 1981 ya se dedicaba a distribuir software mediante envío postal en disquetes de 5 ¼, que debían ser devueltos a la revista, por cierto, y que merecería un artículo aparte.

A través de Softdisk sus usuarios creaban e intercambiaban software y cuatro de estos aficionados deciden pasar a hacerlo de forma profesional, cobrando por esos contenidos. La producción de id Software empieza en 1988 con títulos de éxito relativo como Commander Keen o Rescue Rover, hasta 1992, donde presentan un notable Wolfenstein 3D. Pero su aldabonazo a la historia de los videojuegos llega en 1993 con una obra maestra: Doom.

Doom hizo que muchos de los “consoleros” de 16 bit pasáramos a PC. Eran los tiempos de un recién estrenado Intel Pentium y de los primeros reproductores de CD e id Software acababa de darle al PC su mejor argumento como plataforma de juego: los FPS, disparos en primera persona. El género más exitoso de las últimas dos décadas que sí, se podrá jugar en consola, pero nunca con la precisión y velocidad que permiten teclado y ratón. Junto con los títulos de estrategia, los FPS se llevaron a muchos jugadores al PC y aún faltaba lo más determinante para que dejase atrás a las consolas en cuanto a posibilidades de ocio: Internet.

A principios de los 90, este que os escribe, para actualizar los controladores de su 486 debía coger el coche y viajar 80 Km hasta una tienda donde un ordenador permitía navegar por internet metiendo monedas, exactamente igual que una cabina telefónica. Allí descargabas lo que fuese en un disquete de 3,5 y a casa. Ante esas dificultades decidí conectarme a Internet. Acababa de arrancar 1995 y en España los “conectados” rondábamos los 30.000, el 0,08% de la población y la red muy, muy distinta a la de ahora.

Sin embargo, aquello ya permitía lo mismo que la Internet de ahora; abrirse al mundo. Conocer otros productos, otros fabricantes y comprobar, amargamente, que en España estábamos a un nivel tecnológico lamentable, sobre todo en ciudades pequeñas, donde era imposible conseguir la gran mayoría de los productos que en aquellas páginas de HTML plano veíamos. En alguna de aquellas páginas de tecnología, siempre norteamericanas, conocí a 3dfx.

3dfx

Silicon Graphics se estableció como fabricante de sistemas gráficos a comienzos de los 80. Creaban estaciones gráficas capaces de crear entornos 3D muy básicos a cambio de más de mil dólares de la época. Su modelo de negocio era puramente profesional y muestra de ello es que prácticamente desaparecieron cuando las 3D se normalizaron en los PC domésticos a finales de los 90.

Y ese paso de lo profesional a los hogares comenzó precisamente con tres de sus becarios que decidieron abandonar la empresa para fundar una nueva: 3dfx. Lo harían en 1994 en San José, California, por supuesto, con el objetivo de crear hardware gráfico con posibilidades 3d a un precio asequible. Sus primeros chips gráficos se destinaron a las máquinas recreativas arcade, aún en su apogeo, pero ya amenazadas por la calidad gráfica que ofrecían las consolas 16 bit.

En 1996 ponen en el mercado sus chips Voodoo Graphics. Este lanzamiento supone el pistoletazo de salida para muchas cosas: para la carrera por el mejor hardware gráfico, para la de los mejores gráficos en los juegos, para la de los “productos gamer” …

Los Voodoo eran chips que, como el nombre de su fabricante indica, permitían “efectos 3D”. 3dfx únicamente diseñaba y fabricaba los chips, debiendo ser los fabricantes tradicionales de tarjetas gráficas los que los implementaran en un PCB. Las primeras Voodoo 1 contaban con un procesador gráfico y entre 4 y 8 MB de RAM, todo ello funcionando a 50MHz sobre un puerto PCI.

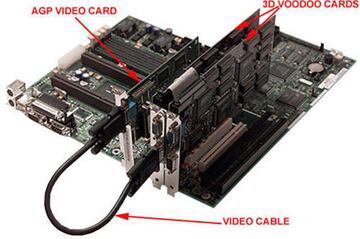

Se trataba de un hardware complementario, diseñado exclusivamente para jugar. Un componente más que podías instalar en un PC, como quien instala un módem o un lector CD. No sustituía a la tarjeta gráfica, sino que se instalaba entre ésta y el monitor. Un cable VGA iba de la gráfica a las Voodoo y otro igual salía de ésta hacia el monitor.

De este modo, el PC funcionaba normalmente y solo cuando ejecutábamos un juego que estuviese expresamente programado para aprovechar la Voodoo, ésta empezaba a “acelerar” los procesos gráficos. Comenzaba la era de las “aceleradoras 3D”.

Pero la cosa no era tan sencilla como comprar una tarjeta gráfica extra y mejorar los juegos. De por medio estaba también el software. 3dfx proporcionó para sus Voodoo una interfaz de programación propia, el GLIDE. Esta API se sumaría a las dos que más se utilizarían en la época para juegos 3D: el reciente Direct3D de Microsoft y OpenGL de Silicon Graphics. Para que las Voodoo mostrasen todo su potencial, el juego debía soportar GLIDE.

Aunque parezca lo contrario, GLIDE fue un acierto para 3dfx. Mientras Direct3D y OpenGL eran unos estándares flexibles, que buscaban la compatibilidad y la sencillez de programación, GLIDE permitía programar por y para los chips Voodoo. Esta programación permitía una importante optimización, lo que acabó consiguiendo que un juego corriendo en Glide sobre una Voodoo no tuviese nada que ver con el mismo juego corriendo en D3D.

Hoy día resulta casi imposible saber si un juego se está ejecutando sobre una NVIDIA o una AMD. Cuando 3dfx puso en el mercado sus Voodoo la realidad es que un juego acelerado por ese hardware mejoraba tanto gráficamente que justificaba las 35.000 pesetas (unos 190€) que costaban. En Youtube podréis encontrar un puñado de vídeos de la época, como el siguiente:

Mientras, en España y Sudamérica no había nada similar y nos conformábamos con lo que había. Pero tuvieron que volver los chicos de id Software a dar un nuevo empujón a la historia del “gaming”.

En id Software 1996 lanza Quake. Como jugador de incontables títulos y plataformas desde las arcade Space Invaders, me atrevo a asegurar que aquel título de id Software fue el más trascendental de nuestra corta, pero nutrida, historia de los videojuegos. No solo consagró el género FPS e inició el multijugador competitivo sobre Internet y red local; además supuso la piedra de toque a partir de la que apreciar lo que podía ser jun juego 3D “acelerado”.

Jhon Romero, creador de Quake, mantuvo una especie de enamoramiento con 3dfx. No solo ponía a este fabricante por las nubes en cada entrevista, sino que id Software optimizó Quake y Quake 2 para sacar todo el rendimiento a sus Voodoo Graphics. La simbiosis era perfecta. Quake y Voodoo eran un matrimonio perfecto que quedaban tan por encima de cualquier otra experiencia de juego que los hacían imprescindibles.

He de reconocer que estaba totalmente enganchado a Quake. La experiencia de juego no era comparable a nada visto hasta entonces. Por otra parte, las primeras partidas con otras personas en Internet, “gracias” a los nuevos módem de 33600bps, me seguían pareciendo magia. Y hablamos de partidas con complicadas configuraciones, continuos cortes, latencias de dos segundos y todo el hogar sin teléfono. Así que había que conseguir una Voodoo y la pude comprar, por fin, en Madrid.

Diamond Multimedia, fabricante completamente norteamericano, fue el principal ensamblador de chips Voodoo y sus 3D Monster fueron las primeras en llegar a España. La primera partida de Quake con la Voodoo… aquel primer cohete que cruzaba el escenario iluminando de forma dinámica las paredes, los sombreados, la fluidez… definitivamente era imposible no engancharse a la aceleración 3D. Había dado comienzo una nueva época en el ocio electrónico.

3dfx y su primer conflicto: SEGA.

Lo de 3dfx no fue un crecimiento. Fue una explosión. No daban abasto a producir procesadores Voodoo y muy pocos ensambladores querían permanecer fuera de ese estallido de las 3D. O bien ensamblaron Voodoo, o se pusieron a desarrollar hardware propio. En poco más de un año el mercado se inundó de procesadores 3D. La guerra había comenzado. Una de las más cruentas en la historia que repasamos en esta serie de reportajes.

Pero antes de entrar en ella, hemos de narrar un hecho que, con seguridad, resultó determinante para el futuro de 3dfx y, por extensión, de todo el panorama 3D.

En 1997 SEGA se encontraba en pleno desarrollo de la sucesora de Sega Saturn. Aunque aún no tenía ese nombre, hablamos de Sega Dreamcast. Para su hardware Sega contaba en Japón con NEC y Videologic desarrollando el proyecto, bajo nombre clave “Katana”. Mientras, en Estados Unidos, Sega América propuso un desarrollo alternativo, éste basado en el nuevo hardware 3D de 3dfx. Si bien se puede pensar que no dejaba de ser una misma compañía, Sega Japón y Sega América eran entidades diferentes, prácticamente autónomas. La matriz de Sega no impidió que Sega América llevase un desarrollo paralelo al de Sega Japón. Su posición era simplemente esperar a ver cuál de los dos proyectos era mejor y usarlo para su nueva consola.

Sin embargo, desde la perspectiva que hoy tenemos, el criterio de Sega nunca fue totalmente imparcial. Finalmente el proyecto elegido fue el desarrollado en Japón, el Katana, dejando a Sega América con un proyecto, que habían bautizado como BlackBelt, totalmente funcional, pero destinado a la papelera. Había sido una tremenda inversión de tiempo y dinero tirada a la basura.

Las razones por las que prevaleció Katana sobre BlackBelt son varias; algunas reconocidas y otras no. Entre las no reconocidas está que Sega, como compañía japonesa, siempre iba a apostar por socios japoneses. No se trata de nacionalismo o proteccionismo, sino simplemente una idea de negocio que los japoneses siempre han mantenido y con la que les ha ido bastante bien. Por otra parte no se fiaban de que un hardware basado en chips de 3dfx, que se estaban instalando masivamente en los PC, no permitiese una emulación demasiado sencilla de la consola en estos PC. El terror a ser pirateados estaba mucho más justificado con 3dfx que con un hardware exclusivo como el desarrollado por Videologic.

En cuanto a las razones sí reconocidas hay una muy evidente: el hardware de NEC y Videologic era mucho más potente y efectivo que el de 3dfx. Como se convertiría en una normal, 3dfx hacía pocas cosas pero de forma muy efectiva, mientras que desde Videologic se permitían más posibilidades, era un proyecto más transversal.

Pero, por encima de todo, queda la polémica que generó la propia 3dfx. En abril de 1997, con la compañía en la cresta de la ola, 3dfx decide salir a bolsa. La decisión es acertada porque requerían crecer para poder seguir comandando la escena 3D. Sin embargo, cometieron un grave error. Con el fin de mostrarse aún más atractivos a los inversores, 3dfx reveló el contrato que tenía con SEGA para desarrollar su nueva consola. Aquello cayó realmente mal en SEGA, que mantenía el desarrollo en secreto. Si ya las cosas eran complicadas para Sega América y el proyecto BlackBelt, la metedura de pata de 3dfx conllevó un casi inmediato rechazo de ese proyecto por parte de SEGA.

3dfx no solo acababa de quedar en evidencia frente a sus inversores, sino que había perdido mucho tiempo y dinero con un proyecto que fue directamente a la basura. No solo eso, sino que les llevó a una guerra con la propia Sega América, a los que demandaron por incumplimiento de contrato. Aquellas demandas quedaron en nada y solo sirvieron para aumentar las grietas que ya asomaban en una 3dfx que evidenciaba cómo no era capaz de digerir su propio éxito.

Mientras, el resto de fabricantes estaba volcado en las 3D. Matrox, S3, ATi, Cirrus Logic, Trident, DEC, SiS… y una joven empresa situada a escasos kilómetros de 3dfx, en la misma San José, de nombre nVidia.

La edad dorada de las aceleradoras 3D

En 1997 ya habíamos fundado Meristation. Éramos el único medio online en español y nos centrábamos en el PC. De hecho, el propio nombre de “Meristation” se formula como una reivindicación de la potencia como plataforma de juegos del PC frente a las PlayStation que se extendían por los hogares españoles. Y hablando de PC, era imperiosamente necesario que los hispanohablantes conocieran de la existencia de tantos y tantos productos que no recibían atención en nuestro país. Fabricantes que no invertían en publicidad en los medios convencionales en español y que eran totalmente pasados por alto. Creamos el canal de hardware de Meristation y el primer artículo se dedicó a aquella Diamond Monster 3D y a su chip Voodoo Graphics. Era solo el principio.

El año anterior, con el lanzamiento de Voodoo Graphics, 3dfx se hizo con el la totalidad del mercado del hardware 3D para juegos, mientras las tarjetas gráficas 2D seguían siendo un coto repartido casi al completo entre S3, ATi, IBM o SiS. Un año después, en 1997, alrededor de cuarenta fabricantes estaban desarrollando y lanzando al mercado hardware 3D.

VideoLogic aprovechó su desarrollo para DreamCast y puso en el mercado los procesadores Kyro. Rendition tenía sus Verite 1000. ATi lanzó su línea Rage. S3 sus Virge. 3DLabs tuvo sus Permedia… Comenzaba una era irrepetible y no por la cantidad de productos, que también, sino por su variedad. Cada fabricante puso encima de la mesa su propia concepción de lo que podían ser las 3D. Cada chip tenía una arquitectura totalmente única, propia de un desarrollo independiente y desde cero.

Los fabricantes anunciaban sus productos, que nosotros seguíamos hasta su lanzamiento. En ese momento nos llegaban los primeros prototipos y comenzaban los test. No se trataba de ver cuántos FPS conseguía cada tarjeta, sino de ver qué podía hacer y cómo lo hacía. Un juego con una S3 se veía completamente distinto a cómo corría con una Rage. Había variables muy subjetivas, como el aspecto del color, el nivel de filtrado o cómo se resolvían las sombras o los texturados. Eran tiempos de capturas de pantalla, de ampliar y de comparar… para después discutir si era más atractivo lo que ofrecía uno u otro producto.

Los distintos fabricantes de hardware fueron conscientes del gran pastel que ofrecían las 3D “domésticas” y pelearon por su porción. Técnicamente era una auténtica gozada estudiar cómo cada arquitectura buscaba los mejores resultados. Recuerdo con especial cariño los chips Kyro, de VideoLogic, por los que apostó fuerte un fabricante por aquel entonces muy importante, Guillemot.

Los Kyro, fabricados por ST Microelectronics, la por entonces fábrica de chips de Nokia, partían de una concepción totalmente diferente al resto. Mientras que 3dfx y demás dibujaban polígonos en 3D, los Kyro solo dibujaban aquellas superficies visibles. Dicho de un modo simple, no tenían que hacer ningún cálculo sobre nada que no fuesen los 800x600 visibles, ahorrando así gran parte de los recursos. Y los recuerdo con cariño porque dentro de su filosofía estaba que los chips 3D podían ser mucho más baratos de lo que lo estaban siendo y que para una tarjeta gráfica siempre sería suficiente con 6 u 8 MB de RAM.

Los Kyro, o sus sucesores Kyro II… al igual que los Rage, los Virge, los Permedia… todos tuvieron una existencia breve, con una agonía más o menos larga, siendo directamente aplastados por dos fabricantes que ya imagináis. 3dfx y una nVidia de la que ahora hablaremos.

¿Por qué fracasaron todas estas tecnologías? Porque eran evidentemente peores. No circunstancialmente peores, sino de una forma muy evidente. Y aquel fue nuestro desagradable trabajo durante aquellos, por otra parte muy interesantes y divertidos, primeros años de las 3D. Seguíamos, probábamos, analizábamos, mostrábamos y publicábamos conclusiones, condenando a muchas de estas tecnologías. Por suerte eran tiempos donde podíamos dedicar un par de semanas a probar un nuevo producto, haciendo comparativas realmente serias sobre PC exclusivamente dedicados al “benchmarking”, una tarea hoy imposible, cuando incluso antes de lanzarse un producto, cien youtubers han publicado sus conclusiones sobre él. Era cuestión de selección natural, de pura supervivencia, y solo sobrevivieron los mejores.

Podéis encontrar entre los artículos más antiguos de Meristation análisis de este tipo, pero hoy no tendrían más sentido que la simple curiosidad. Seguramente es mucho más ameno ver el vídeo siguiente, o cualquier otro de la misma serie, donde se comparan los rendimientos en los títulos del momento de tarjetas como las S3 Virge o las Matrox Mystique con una Voodoo 1.

3dfx y nVidia

Al igual que tantas empresas de Silicon Valley, nVidia la crean varios especialistas que venían trabajando en otras compañías del sector. Jen-Hsun Huang, de origen taiwanés, era diseñador para AMD, mientras que su socio, Chris Malachowsky, trabajaba en HP y Sun. Aunque se suele pensar lo contrario, nVidia es anterior a 3dfx. Se establecen en 1993 y en 1995 ya tienen en el mercado productos con su primer chip gráfico, el NV1, que se distribuyó con el nombre comercial de Edge 3D.

Los Edge 3D, vendidos principalmente por Diamond (el fabricante más accesible dada su ubicación en la misma California), no fueron valorados en su justa medida ya que, desde la perspectiva de hoy, ya eran un producto revolucionario. En una misma tarjeta incluían procesador 2D y 3D, tarjeta de sonido de 32 canales, 4 MB de VRAM y puerto para joystick. Sin embargo, fueron un completo fracaso. La razón es que hacían muchas cosas, pero no destacaba especialmente en ninguna de ellas y contar con tanto hardware la hacía excesivamente cara. Como puntilla, en ese mismo 1995 Microsoft lanzó las especificaciones de su primera versión de las librerías DirectX y el NV1 no era compatible con ellas. Estaba definitivamente condenado.

Curiosamente, antes de hacerlo con 3dfx, SEGA América había acudido a nVidia para desarrollar el comentado hardware gráfico del proyecto Blackbelt (Dreamcast). Ambos fabricantes habían consolidado una buena relación gracias a los “port” de juegos de la consola Sega Saturn a PC. La arquitectura del primer NV1 y Saturn eran bastante similares, lo que facilitaba esta tarea. La relación era tan estrecha que las tarjetas gráficas NV1, las Edge 3D, eran compatibles con los gamepad de Saturn. Sin embargo, la tecnología de mapeado de texturas de nVidia no gustaba a los programadores de Sega, que no la veían con futuro, prefiriendo apostar por el renderizado poligonal. Estos técnicos acertaron dado que la tecnología de nVidia quedaría completamente obsoleta meses después, con la citada incompatibilidad con los DirectX de Microsoft.

Al igual que pasó con 3dfx, nVidia comenzó a desarrollar un hardware gráfico para Dreamcast y tuvo de cancelarlo. El nombre clave que nVidia le dio a aquel proyecto era NV2. Su desarrollo no llegó a los extremos del que luego llevaría 3dfx, que llegó a concluirlo, pero, aun así, fue un segundo fracaso que se sumó al del NV1.

Aquellos dos primeros productos llevaron a la ruina práctica a nVidia, que estuvo a punto de desaparecer. Sin embargo, lo intentaron por tercera vez. Sería el NV3, con nombre comercial RIVA 128.

nVidia RIVA128

RIVA, acrónimo de “Aceleradora Interactiva de Video y Animación en tiempo Real” era un procesador 2D y 3D, 128 bits, perfectamente optimizado para DirectX y para MPEG-2 y, por encima de todo, compatible con la nueva arquitectura AGP de Intel. Era un producto muy “redondo”, pero que no destacaba especialmente en ninguna de sus vertientes.

Y hablando de videojuegos, el cruce entre las 3dfx Voodoo y las nVidia Riva 128 fue claramente favorable a las primeras. La causa fueron las distintas tecnologías de renderizado que utilizaban. Mientras que nVidia utilizaba el mapeado de bits (mipmapping) por polígonos, 3dfx utilizaba un mapeado el más costoso, pero más eficaz, mapeado por pixel. El texturado de polígonos completos de nVidia provocaba que estos se hicieran visibles repentinamente en pantalla, el clásico “popping”, mientras que el texturado por pixel de 3dfx permitía secuencias más fluidas, además de que las texturas eran mucho más precisas.

Dicho de un modo simple, 3dfx había ganado la primera batalla gracias a que toda su potencia bruta se dirigía a generar los mejores gráficos 3D en juegos, sacando especial ventaja en aquellos compatibles con su API GLIDE o el MiniGL de id Software. Por el contrario, nVidia tenía un producto que efectivamente se quedaba atrás en esa faceta, pero que podía hacer todo lo demás. No requería de una segunda tarjeta gráfica, como las 3dfx, y permitía otras funciones que quedaban lejos de las Voodoo, como los ya comentados soportes para Direct3D, el puerto AGP, renderizado 3D en ventana o resoluciones más altas. Estas condiciones permitían que sus rendimientos fuesen mejorando a medida que mejoraban sus controladores a la hora de aprovechar los nuevos DirectX y del puerto AGP, mientras las Voodoo se mantenían estancadas. Esta evolución permitió el lanzamiento de una revisión del procesador bautizado como RIVA 128ZX, con más RAM, RAMDAC de 250 MHz y soporte para AGPx2.

El epitafio de 3dfx. Los 14 meses.

3dfx había golpeado primero y se había hecho con el mercado, pero la competencia había llegado fuerte. Voodoo 1 era un producto muy específico, limitado, y la aventura con Sega había acabado en fracaso. 3dfx debía tranquilizar a sus inversores e hicieron unas declaraciones que más tarde pesarían como una losa sobre su historia.

Hablaron de los 14 meses. Según 3dfx, a su competencia les había costado 14 meses llegar hasta donde ellos estaban, 14 meses en los que ellos habían seguido avanzando. Daba igual lo que hiciera la competencia, porque ellos siempre estarían 14 meses por delante.

El error de 3dfx resulta hoy evidente. Asumió que la ventaja sobre la competencia no estaba en su tecnología, ni en su potencial humano o técnico. Ni siquiera radicaba en sus ideas o proyectos. 3dfx acababa de simplificar el mercado del hardware gráfico como una carrera, enorgulleciéndose de que en la misma ellos iban 14 meses por delante y que, según su opinión, esa era una ventaja inalcanzable para el resto. Qué equivocados estaban…

Voodoo Rush

3dfx vivía sus mejores años. Sus Voodoo Graphics las montaban fabricantes como la citada Diamond, Canopus, Miro, Colormaster, Leadtek, Quantum 3D… pero eran conscientes de las limitaciones de su arquitectura, sobre todo de la obligación de contar con una tarjeta 2D junto a sus Voodoo. Así que en 1997 deciden poner en el mercado un producto con su potencial 3D e integrando un procesador 2D que hiciera innecesario comprar dos tarjetas gráficas.

El objetivo era claro, pero la ejecución fue pésima. Básicamente lo que hicieron fue implementar un mediocre procesador 2D de Alliance Semiconductor en una Voodoo I. El “invento” no tuvo en cuenta que ambos procesadores deberían compartir memoria y que se enfrentaban al tremendo cuello de botella que ya suponía el puerto PCI para los gráficos. Las primeras Voodoo Rush fueron un fracaso.

En aquel momento tanto usuarios como prensa manteníamos a 3dfx en un pedestal propio de unos visionarios que habían sido capaces de revolucionar tecnología y videojuegos. Esperábamos los Rush como algo propio de aquellos seres y lo que recibimos fue una auténtica chapuza. Su rendimiento en 2D era malo y el Voodoo se veía ralentizado por sucesivos cuellos de botella. Rendían menos que sus predecesoras y, además, resultaban caras. Bastó un único golpe para bajar a 3dfx de su pedestal.

Los errores de Rush eran tan evidentes que parecían impropios de un fabricante puntero como 3dfx. Quizá los recursos destinados en aquel periodo a Sega y su Blackbelt influyeron en ello. En todo caso, eran paliables y se pusieron a ello. Pronto lanzaron Voodoo Rush con 8 MB de RAM y cambiaron el chip 2D por uno mucho más digno de Cirrus Logic. Pero era tarde. Rush ya se había colgado el cartel de fracaso y nunca remontaría.

No sabemos cuántos, pero de los 14 meses de ventaja de 3dfx, se habían perdido varios…

Voodoo 2, o la fuerza bruta.

3dfx debía recuperarse del mazazo de su aventura 2D y volvieron a lo que realmente controlaban: el 3D puro. En 1998 lanzaron Voodoo 2 y apostaron de nuevo por la potencia bruta. Se añadió una segunda unidad de texturas, se dobló la cantidad de memoria y se aumentaron todas las frecuencias. Además, se implementó una arquitectura con tres procesadores, mientras el resto de la competencia usaba uno. Este multiproceso permitió las primeras texturas múltiples en los videojuegos, que fueron muy bien acogidas por los programadores.

En su contra, las Voodoo 2 debían ser montadas como hardware añadido a una tarjeta 2D principal, por tanto eran tarjetas exclusivamente para puerto PCI, y su resolución máxima seguía siendo de 800x600.

Seguían siendo las más rápidas en lo suyo. Lo poco que hacían, lo hacían a la perfección, pero se estaban convirtiendo en un producto algo exclusivo y del gusto de cada vez menos usuarios. A no ser que fueses un fanático de los juegos 3D, resultaba más práctico y barato comprar una buena tarjeta “completa”, con funciones 2D y 3D, aunque no se alcanzasen las cotas que las Voodoo ofrecían en ese último ámbito. Para colmo, Intel entra de lleno en el hardware gráfico con su i740 que, aunque no fuese una maravilla, era un producto a tener en cuenta dado quien era su fabricante y su posición en cuanto a micros y chipsets.

Arrinconada, 3dfx da un nuevo golpe en la mesa. Si Voodoo 2 era potencia bruta, se aplicó la misma fórmula presentando la tecnología SLI.

Scan-Line Interleve lo que permitía era instalar dos Voodoo 2 en sendos puertos PCI, interconectarlas y que cada una dibujase una línea de la escena, de forma intercalada. Con dos tarjetas totalmente independientes no había problemas de cuello de botella y el rendimiento prácticamente duplicaba al de la tarjeta individual. Además de ese rendimiento doble, la mayor ventaja de SLI era que por fin se podían superar los 800x600, llegando a los 1024x768.

Recuerdo las Voodoo 2 en SLI como lo más absurdo que he instalado en un PC. Dos tarjetas enormes, que no cabían en cualquier caja, que obligaban a quitar la tarjeta de sonido para ocupar su ranura PCI, que requerían una segunda fuente de alimentación para funcionar, que generaban tal cantidad de calor que obligaban a abrir el PC… pero esto no era lo realmente obsceno de la configuración, sino los resultados que ofrecía.

Cualquier juego de la época corriendo bajo esta configuración pasaba los 120 FPS. Juegos optimizados para GLIDE pasaban los 200 FPS… y los monitores de entonces, aquellos CRT de 4/3 y 17 pulgadas, no pasaban de 50 hz.

Así que 3dfx se pasó de frenada. Apostó por un producto desproporcionado, poco práctico, caro, incómodo. Eso sí, no recuerdo otro producto que haya despertado tanto morbo como aquel, por lo excesivo que siempre fue.

Lo que sí hay que valorar fue la invención por parte de 3dfx de la tecnología SLI. Sería una base sobre la que seguirían creciendo y que, como sabemos, es de lo poco que sobrevivió a la empresa.

RIVA TNT. nVidia recorta los 14 meses.

Mientras, nVidia había conseguido optimizar los controladores de su NV3 hasta el punto de conseguir unos rendimientos muy superiores a los de su lanzamiento. Las Riva128 y ZX empezaban a resultar más que interesantes, pero había que seguir evolucionando el hardware. En 1998, casi simultáneamente a las Voodoo 2, nVidia lanza sus NV4, las Riva TNT. El TNT, de “TwiN Texel” supondría el lanzamiento definitivo de este fabricante hacia lo que es hoy.

Los TNT hacían de todo y lo hacían muy bien. 16 MB de RAM, AGP y, sobre todo, eran pequeñas tarjetas que se limitaban a su puerto AGP. No eran tarjetas que destacasen especialmente frente a productos como los Rage 128 de ATi o los G400 de Matrox, pero daban una total sensación de ser una compra inteligente: bueno, bonito y barato.

El acierto de nVidia fue el de saber hacerse con una parte del mercado que no era precisamente pequeña y que consistía en todos aquellos jugadores que no tenían el dinero o las ganas de complicarse la vida con aceleradoras 3D como las Voodoo. Las 3dfx cada vez se veían más arrinconadas en su parcela de “hardcores” y aquello les exigía un nuevo movimiento.

Voodoo Banshee. Tratando de recuperar distancia.

Como respuesta a los chips todoterreno de la competencia, 3dfx lanzó las Voodoo Banshee. Se trataba de ofrecer la potencia y prestaciones de las Voodoo 2 en entornos OpenGL y GLIDE, en una única tarjeta AGP. Básicamente era un refrito de las tecnologías anteriores, combinando tecnologías propias de Voodoo 2 y Voodoo 1. El rendimiento era aceptable, sin destacar sobre el de la competencia. Sacaba partido del mejor dominio de OpenGL y del API propietario GLIDE, pero no estaba optimizada para Direct3D. Se vendió bien dado su sello de 3dfx, pero tanto sobre el papel, como en los resultados, ya resultaba un hardware inferior al mostrado por nVidia con sus TNT.

3dfx estaba aceptando que sus 14 meses de ventaja se habían recortado, incluso desaparecido. No tenía en ese momento en el mercado un producto que realmente aventajase a la competencia salvo en entornos muy concretos. En lugar de aceptarlo, doblan la apuesta asegurando que tienen entre manos un proyecto que lo cambiará todo y devolverá a 3dfx su ventaja. Lo denominan “Proyecto Rampage”. El “hype” estaba otra vez servido. 3dfx regresaría a por sus fueros.

Y mientras…

Mientras tanto, nVidia seguía a lo suyo. Al Riva TNT le sucede el TNT2. 128 bit, 32 Mb de VRAM, soporte AGPx4, color verdadero (32 bit) y una evolución en su proceso de fabricación que la llevó a la tecnología de 0,25 micras. Menos consumo, menos calor y mayores frecuencias, pasando de los 90 MHz de las primeras TNT a 150. nVdia se había convertido en un fabricante eficiente. Todo lo que hacía, lo hacía bien. Eran eficientes, confiables, no tenían flaquezas. Comenzaron a hacerse con el mercado del hardware gráfico. No solo se hacían con los jugadores que perdía 3dfx, cada vez más exclusivista, sino que empezó a atacar al resto de fabricantes.

Del TNT2 lanzó una versión de 64 bit, denominada nVidia Vanta, directamente dirigida a competir en el mercado ajeno a los juegos 3D, el de ordenadores “comunes” y ofimáticos que controlaba completamente ATi.

nVidia se estaba situando como referente en la fabricación de hardware gráfico. La mayoría de otros fabricantes ya habían desistido. No tenía sentido competir en esa loca carrera. Cada lanzamiento llegaba al mercado en un momento en el que ya había sido superado en prestaciones por otro producto de la competencia, generalmente de nVidia. Desaparecieron la gran mayoría de productos y de aquellos 40 fabricantes desarrollando hardware 3D que comentábamos hace unos párrafos, no quedaban más que los conocidos 3dfx y nVidia, escoltados por ATi, que seguía siendo la que más dinero generaba gracias a que la mayoría de los usuarios de PC no estaban interesados en los juegos. Partíamos de un mercado con demasiadas opciones hacia lo diametralmente opuesto, el monopolio.

En esa época, en un momento determinado, llegó una nota de prensa de nVidia diciendo que a partir de ese momento su denominación oficial pasaba a ser NVIDIA.

Riva TNT 2 Vs Voodoo 3. El asalto definitivo.

El gran combate entre los dos pesos pesados, aquel realmente disputado, tuvo lugar entre estos dos chips gráficos. Era obvio que los 14 meses de 3dfx se habían quedado en nada. Cuando lanzan su Voodoo 3, con el nombre clave de “avenger” (vengador) se encuentran con una respuesta tan eficiente como el TNT2. No hubo venganza alguna.

Pero no solo era cuestión de rendimiento, era más una cuestión de sensaciones. Mientras NVIDIA seguía cambiando arquitecturas, implementando todas las posibilidades que le daban la evolución tanto de chipsets como de software, 3dfx seguía estancada en su misma arquitectura.

Como en un deja vu, Voodoo 3 volvía a ser un refrito de la arquitectura Voodoo 2, sumando las posibilidades 2D de sus Banshee. Volvía a destacar, por tanto, con su fuerza bruta en determinadas situaciones favorables, pero hacía aguas en otras muchas. Nace limitada a AGPx2, a color de 16 bit, a texturas con un máximo de 256x256… mientras TNT2 aprovecha AGPx4, color de 32 bit y maneja texturas de 2048x2048.

Algunos títulos optimizados para el hardware de 3dfx permiten sacar pecho a este fabricante, pero en líneas generales, ante cualquiera que sepa leer un poco entre especificaciones, está claramente por detrás del hardware de la competencia. Aun así, Voodoo 3 no vende mal, permitiendo un último asalto para 3dfx.

El comienzo del fin de 3dfx

Pero independientemente de cómo vendiera Voodoo 3, el futuro de 3dfx ya estaba condenado. Poco antes de su lanzamiento el fabricante de chips gráficos tomó la que quizá fuese su peor decisión. Como forma de aumentar sus ingresos decide fabricar al completo las tarjetas gráficas.

Hasta ese momento no le había ido nada mal fabricando solo los procesadores y contando desde el primer momento con gran cantidad de fabricantes que los montaban, pero deciden comprar la factoría de STB y fabricar sus propias tarjetas gráficas al completo.

Con esta decisión lo primero que consiguen es convertir a todas aquellas marcas que habían sido sus aliadas, que habían vendido el nombre de 3dfx por todo el mundo, en sus marcas rivales. Si la porción del mercado que mantenía 3dfx se iba reduciendo, aquella decisión la redujo muchísimo más. Aquellos fabricantes a los que dejó fuera obviamente acabaron en los brazos de NVIDIA. Y no hablamos solo de números; el hecho de tener a otras compañías “vendiendo” tu producto permite un posicionamiento en el mercado en lo que se refiere a presencia en tiendas, prensa, soporte técnico, desarrolladores… que difícilmente es posible tener como fabricante individual.

Por otra parte, la factoría de STB, situada en Juárez, Méjico, no funcionaba. Problemas de fabricación, componentes de escasa calidad, PCB de menos capas que los de la competencia… Que la decisión había sido un error era cada vez más evidente.

Para colmo de males, quizá como puntilla a 3dfx, además de perder a sus ensambladores, con Voodoo 3 3dfx perdió a otro importante aliado: a John Romero. El de id Software seguía en su papel de gurú de los videojuegos y había sido un duro defensor de 3dfx desde su lanzamiento, beneficiando mucho al fabricante no solo con sus apreciaciones, también con el soporte de GLIDE y la optimización de sus juegos para ellos.

Pero con Voodoo 3 Romero sale a los medios diciendo que 3dfx agotaba su trayectoria, que no avanzaban, que se habían dejado comer toda la ventaja que obtuvieron llegando los primeros. En definitiva, dijo lo que todo el mundo opinaba, pero desde una posición mucho más visible.

Un último intento.

Titulo este párrafo así porque hacerlo con “los estertores de 3dfx” no me parecía apropiado, pero es lo que realmente tuvo esta compañía a partir de 1999. 3dfx moría precisamente por aquello que ellos mismos habían iniciado: una carrera por prevalecer, por golpear primero, por dejar atrás a la competencia.

Voodoo 3 no era un mal hardware, pero la competencia había llegado más lejos. 3dfx aún lo intentó una vez más. Esta vez al proyecto le llamó Napalm. Suponemos que cuando lo bautizaron con tan abrasador nombre pensarían en su competencia, pero la destrucción no cayó precisamente sobre aquellos.

Las espectativas sobre Napalm seguían siendo altas, como podemos ver en nuestros propios avances, pero el proyecto Voodoo 4 nace directamente muerto. Las primeras Voodoo 4, aquel napalm del que hablaban, no llegan a ponerse a la venta. La razón es que mientras 3dfx desarrollaba ese chip, la enésima iteración de la arquitectura Voodoo, un nuevo refrito de las Voodoo 3 adaptadas a las exigencias del momento, NVIDIA había presentado su primera GeForce.

En otro artículo hablaremos de lo que NVIDIA consiguió entonces y lo que supuso la llegada de las GPU integrales que hoy tenemos, pero en la presente historia lo que supuso para 3dfx es la vergüenza de tener que tirar a la basura un producto que nunca llegaría a ver la luz, porque hubiese sido literalmente barrido por las NVIDIA. No solo eso. ATi se había unido por fin a la fiesta de las tarjetas 3D para jugadores y había presentado sus Radeon. 3dfx, con Voodoo 4, llevaba una navaja a un tiroteo. Habían retado a su competencia a una carrera y ahora iban los últimos.

El último intento de 3dfx fue el de siempre: seguir sumando hardware para superar así a la competencia en rendimiento. Fuerza bruta. Así creo su arquitectura escalable. Es otra de esas aportaciones que habrá que agradecerles. Se basaba en combinar varios procesadores de forma que sumaran su potencia y superaran la de la competencia.

Denominó a sus chips VSA (Voodoo Scalable Architecture) y planteó una serie de productos cuya potencia radicaba en la cantidad de procesadores VSA que incluían. A más procesadores, más potencia. Simple.

¿El problema? El de siempre. Para cuando 3dfx pone en el mercado sus Voodoo 4, NVIDIA ha hecho lo propio con sus GeForce 2. 3dfx aborta varios de sus modelos, las Voodoo 4 4000, las 4200, las 4800… proyectos nonatos. Lanza las Voodoo 4 4500, un procesador ya de 0,25 micras, pero aún AGPx2, funcionando a 166 MHz…

... Y las Voodoo 4 4500 resultan ser un desastre. Acabaron con el poco crédito que le quedaba a 3dfx. No llegaban a los rendimientos de las GeForce 2 más económicas que las ganaban en lo que 3dfx siempre había destacado: en potencia bruta.

3dfx justificó absurdamente este rendimiento con la excusa de que lo importante era la calidad, dado que sus chips en lo único que destacaban en ese momento era el impacto que sobre el rendimiento que tenía el antialias. Curiosa afirmación del fabricante que siempre había apostado por lo contrario y que a su tarjeta ni la había equipado con salida DVI.

3dfx lo volvió a intentar con las Voodoo 5 5500, pero adolecían de lo mismo. No estaban a la altura. Había situaciones, cada vez más rebuscadas, en las que una Voodoo podía competir con una NVIDIA, pero la competición se antojaba como la que tendría lugar entre un superdeportivo y un utilitario al que se le hubiese fijado al techo un reactor de avión con cinta aislante. Podía salir bien, pero nadie apostaría por ello.

Las Voodoo 5 6000, la enésima vuelta de tuerca a la tecnología, con cuatro procesadores VSA100 funcionando conjuntamente, fueron otro de esos productos que se quedó en la mesa de diseño. Sencillamente no eran compatibles con las placas AGPx4 que ya montaban absolutamente todos los PCs nuevos. Su potencia debería haber sido bestial y el error del puerto AGP era subsanable, pero el coste era tan elevado, que no justificaba la fabricación.

Lo mismo ocurrió con los Rampage, aquel producto que devolvería a 3dfx a la cima, y que nunca llegaron a ver la luz, al menos bajo las siglas de 3dfx.

Ya en el año 2000 3dfx entró en proceso de acreedores. Fue demandada por sus proveedores y entró en un proceso judicial que se prolongó durante años. Las cifras de esos años son para asustar. En ese año los ingresos se habían reducido un 84%, mientras que las pérdidas aumentaban un 54%, pero ya en 2001 las cifras se hicieron insostenibles. El balance de pérdidas del año 2000 ascendía a 340 millones de dólares.

En 2001, como única vía de escape para este proceso, 3dfx decidió aceptar la compra por parte de aquella compañía que les habían llevado, literalmente, a la ruina: NVIDIA. 3dfx se vendió a precio de saldo, lo que realmente era. NVIDIA pagó por su rival 113 millones de dólares. El precio es discutible, porque si bien es un precio casi ridículo para una empresa que tres años antes había sido la número 1 del sector, para NVIDIA había muy poco que aprovechar en 3dfx. Efectivamente se quedaron con las patentes, la marca, la tecnología... pero nunca los aprovechó. Aquella compra fue poco más que el tiro de gracia que NVIDIA dio a 3dfx.

Sobre la mesa quedaron proyectos, tecnologías y un buen número de diseñadores e ingenieros. Algunos fueron contratados por NVIDIA, otros fueron a ATi. Tanto ATi como NVIDIA asimilaron de 3dfx la tecnología SLI. Realmente fue ATi la que más se ajustó a ella en Crossfire, dado que NVIDIA, aunque ha mantenido la denominación SLI, utiliza una tecnología muy diferente.

En aquel momento los usuarios, ilusos, buscamos el lado bueno que todo aquello podría tener. La competencia entre 3dfx y NVIDIA había terminado, pero como resultado quizá podríamos tener un fabricante que sumase lo mejor de ambos. No fue así. NVIDIA continuó a su ritmo, sin indicio alguno de que había absorbido a su competidor principal. Ahora tenía otro frente abierto, éste aún mayor, con los canadienses de ATi, dispuestos a amargarles con sus Radeon.

Muy indicativo fue que NVIDIA abandonase por completo cualquier cosa que sonase a 3dfx. Discontinuó sus productos, dejando a todos los usuarios de las Voodoo sin nuevas actualizaciones de controladores o soporte técnico. Lo que hizo en cambio fue ofrecer la sustitución de las tarjetas Voodoo por sus equivalentes de NVIDIA de forma gratuita.

NVIDIA pasó por encima de 3dfx. Les borró del mapa, sin dejar ni rastro de ellos. 3dfx había perdido en la batalla que ellos mismos habían planteado, en esa carrera en la que llegar primero lo era todo. Tristemente se demostró que una vez perdieron la ventaja del primer golpe, no supieron reaccionar, no hubo un segundo. Desde ese momento la existencia de la empresa se basó en resistir los golpes de la competencia hasta no poder más y caer.

Pero hoy nos seguimos alegrando de que 3dfx no haya desaparecido del todo. Como empresa, como desarrolladores, desaparecieron, pero sus productos siguen activos en muchos PC. Es curioso cómo muchos usuarios encumbraron a 3dfx y veneraron sus productos, veneración que hoy se mantiene. La comunidad 3dfx sigue viva, desarrollando controladores para configuraciones Voodoo 2 SLI, para las Voodoo 4, que han llegado a extremos muy por encima de los que alcanzaron bajo la propia 3dfx.

La existencia de 3dfx fue tan intensa, como breve. Y al igual que esos rockeros que mueren jóvenes, 3dfx se convirtió en otra de nuestras leyendas. En tan solo cinco años consiguieron revolucionar el hardware gráfico y los juegos de PC, convirtiendose en el fabricante de referencia. Decenas de otros fabricantes intentaron navegar a su estela con sus correspondientes decenas de tecnologías, de ilusiones y de millones de dólares. Cinco años después todos habían o bien desaparecido, o habían sido absorvidos por la competencia.

Tras esos cinco años un fabricante había prevalecido. Usando referencias de los videojuegos, NVIDIA pasó a ser el rey de la colina, el último hombre en pie. Habían presionado el mercado de tal forma que ningún otro les pudo seguir. Habían ganado la carrera y con ello ponían fin al lustro más interesante que hemos tenido alrededor del PC como plataforma de juego. Además, lamentablemente, también se ponía fin a un mercado lleno de alternativas realmente diferentes, de una abanico real de opciones entre las que elegir, para entrar en un pseudomonopolio donde son demasiado pocos los que marcan tanto el ritmo, como la dirección.

La última década con NVIDIA comandando el hardware 3D también ha tenido sus hitos gracias a unas ATi Radeon que se convirtieron en su única alternativa. Unos años con no menos conflictos y con sus vencedores y vencidos. Esa es otra historia que también merece ser contada.

Parte 1: Una criatura con varios padres.

Parte 2: IBM, Apple y Microsoft