Parte 1. Una criatura con varios padres.

La Historia (más conflictiva) del PC

Nuestro PC de hoy es el resultado de la competencia, más o menos cruenta, entre distintos personajes, compañías y tecnologías. La máquina que ahora disfrutamos era la apuesta de los que mejor lo han hecho o menos escrúpulos han demostrado, dejando atrás a otras tecnologías que nos hubieran llevado por caminos bien distintos. Veamos el recorrido de estos triunfadores y de cómo y por qué se impusieron al resto.

- Primera parte. De como la primera computadora nace y muere bajo las bombas en la Alemania nazi, mientras que en Estados Unidos un genio desarrollaba otra computadora y otro, igual de inteligente, le vendía este desarrollo a la armada con el fin de hacer más letales aquellas mismas bombas. De cómo otro genio desarrollaba arquitecturas computacionales en los ratos libres que le dejaba la creación de la bomba atómica. Y de como una compañía igualmente norteamericana supo aprovechar todo aquello y convertir sus siglas, IBM, en equivalente a computadora, ya sea enviando hombres al espacio, o aplastando a la competencia bajo un monopolio ilegal.

Podemos considerarnos una generación muy afortunada. En tan solo un par de décadas hemos tenido la suerte de presenciar cambios tecnológicos, sociales y culturales como no se habían producido en la ya larga historia de nuestra civilización. Hemos asistido al nacimiento de Internet y su conversión en un elemento imprescindible para cualquiera de nuestras actividades vitales. Hemos sido testigos de cómo nuestra forma de comunicarnos, de organizar nuestra vida, nuestro trabajo y, en lo que más nos corresponde, nuestra forma de divertirnos, nuestro ocio, ha cambiado de forma radical de lo que venía siendo por más de un siglo.

El elemento determinante en esta revolución es el ordenador personal, el PC, y su normalización como elemento de consumo accesible. Y decimos que lo es, no que lo ha sido, dado que aún hoy sigue siendo la puerta de acceso a tecnologías que prometen seguir revolucionando nuestra forma de vivir, como son la Inteligencia Artificial, la Realidad Virtual o el Internet de las cosas.

En este 2019 viviremos cambios paradigmáticos en la industria del PC en general y del hardware gráfico en particular. Nada mejor que conocer de dónde venimos para poder prever hacia dónde vamos.

En esta primera entrega cumplimos con lo que creemos que es obligado, resumir, de la forma más amena e interesante posible, el nacimiento del PC. Es el primer GRAN CONFLICTO que os vamos a narrar, el de la paternidad del PC. A día de hoy muchos se apuntan la paternidad del que seguramente sea el invento más importante del Siglo XX, pero es imposible que todos ellos puedan recibir ese honor ¿o sí?.

En las siguientes líneas os describiremos el quién y el cómo de aquellos años. Y no porque sea una información que sea determinante conocer, sino porque es una historia sencillamente fascinante que deseamos poner a vuestra disposición, donde unos genios locos fueron capaces de desarrollar máquinas hasta entonces imposibles, combinando relés y válvulas de vacío, mientras por otro lado desarrollaban la bomba atómica que arrasaría Japón, calculaban cómo enviar cohetes para bombardear Berlín o trataban de descifrar las comunicaciones de los submarinos U-Boot alemanes.

Personajes capaces de construir máquinas de 260 toneladas, con una longitud de 30 metros y llamarla computadora. De cómo los gobiernos financiaron lo que parecía una locura en su afán por mejorar sus prestaciones militares. Narraremos cómo estos genios se inspiraban en sus iguales, llegando a espiarlos también, en la carrera por crear la computadora definitiva. Seguiremos narranco cómo unos norteamericanos aprovecharon todo aquello y convirtieron una empresa de censado civil en la macrocompañía que permitió a la NASA enviar seres humanos a la Luna. En definitiva, tocaremos a varios, no todos, de los que hoy se nombra como padres de la informática moderna, aquellos que definitivame iniciaron la revolución tecnológica y cultural que nos ha traído hasta lo que hoy somos. Vamos a ello...

Una criatura con cuatro padres... al menos.

La inmensa mayoría de nuestros lectores tienen menos de 40 años, por lo que muy pocos de vosotros habréis conocido un mundo sin ordenadores, sin internet, sin teléfonos móviles. Y aunque tan solo hayan pasado cuatro décadas, describir aquella sociedad se antoja como hablar de una prehistoria tecnológica. Así que toca hacer un esfuerzo e imaginar un mundo en el que no solo no había ordenadores, sino que no se concebía su necesidad. Aquel mérito, el de decir “esto no solo se puede hacer, sino que va a ser muy útil y seré yo quien lo demuestre”, se le concede a Konrad Zuse.

Zuse, ingeniero alemán nacido en 1910, encontraba especialmente pesada la gran cantidad de operaciones que le exigía su trabajo. Como hacemos casi todos, fantaseaba con cómo conseguir que su trabajo se hiciera solo y, como buen ingeniero, comenzó a valorar seriamente la invención de un “robot” que trabajara por él. Por lo que habría que levantar un monumento a Zuse, y a su querencia por querer evitar el trabajo, es que él sí dio el primer paso para conseguirlo.

Paralelamente, en Estados Unidos, IBM llevaba años trabajando en automatización de tareas y sistemas, con grandes avances en la computación mediante tarjetas perforadas, arcaico sistema que sirvió de base a las computadoras “modernas”. Sin embargo, y aunque hay que saber que la invención del PC como hoy lo conocemos llega de la aportación de distintas personas y compañías, es la de Zuse la que nos parece más encomiable. Veremos por qué.

El mérito de Zuse radica en que es el primero en convertir la teoría en práctica. En la historia había habido centenares de "herramientas" destinadas a hacer cálculos de forma automática. El mismo Leonardo Da Vinci, en el Siglo XV, había diseñado lo que denominó "máquina de sumar". Posteriormente se diseñaron y construyeron máquinas capaces de generar cálculos mediante el giro manual de rodillos y otras tecnologías puramente mecánicas. En el Siglo XIX en el Reino Unido ya se conocía la posibilidad de crear máquinas electrónicas, movidas por electricidad, capaces de realizar cálculos de forma automática. Pero nadie fue capaz de pasar de la teoría a la práctica, de fabricar realmente una máquina como aquella. Hasta Zuse.

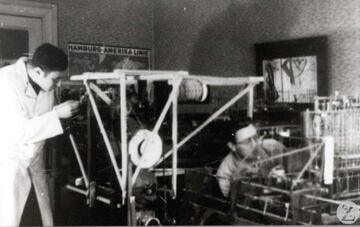

Con veintiséis años Konrad Zuse dejó su prometedor trabajo de ingeniero diseñando aviones para la Luftwaffe de Göring y volvió a casa de sus padres. Imaginad la cara de este matrimonio alemán en la postguerra cuando su hijo abandona un provechoso puesto de ingeniero para inventar una máquina que sumase sola. Pero el joven Konrad se mantuvo en sus trece y dos años después, en 1938, tras acabar con sus ahorros y los de sus padres, logró completar la primera computadora programable de la historia, que bautizó como Zuse1 ó Z1. Se trataba de una calculadora basada en cinta perforada y relés eléctricos que automatizaban procesos, una tecnología que Zuse conocía gracias a la fuerte colaboración que por entonces IBM tenía con la Alemania de Hitler al que surtían de maquinaria de tabulación de datos.

La Z1 podía sumar, restar, multiplicar y dividir, si bien nunca llegó a funcionar correctamente. Sus errores se debían a la dificultad de fabricar manualmente, en un desván, una tecnología con tales exigencias de precisión. No obstante la teoría era la correcta y el camino hacia nuestros PC había dado comienzo.

Desgraciadamente la Segunda Guerra Mundial acabó de la forma más abrupta posible con el proyecto de Zuse. emterrado literalmente en los escombros de una Berlín arrasada por los aliados, y no fue hasta años después, 1946, cuando recuperó sus objetivos y estableció la hoy considerada como primera compañía de computadoras de la historia, la Zuse-Ingenieurbüro Hopferau.

Un mérito que no se le puede discutir a este alemán es el de haber vendido el primer PC "civil" de la historia. Sería la cuarta revisión de su “invento”, una Z4, y fue vendida a una empresa suiza en 1950. Después de aquella, IBM llegaría con sus mucho más reconocidas Mark I. Los norteamericanos adquirieron las patentes de Zuse, que sufría las dificultades inherentes a una Alemania estrangulada por las deudas contraídas a causa de la Segunda Guerra Mundial, y fueron estos los que acabaron normalizado realmente las computadoras entre la década de los cincuenta y sesenta, como después veremos.

En cuanto al visionario Zuse, siguió desarrollando computadoras. Aún consiguió otro gran avance al sustituir la cinta perforada por cinta magnética en su Z12. Pese a ello su compañía fue devorada por una mayor, la también alemana Siemens.

Como curiosidad añadir que la Universidad de Berlín rogó a Zuse que construyera una reproducción de su Z1, con el fin de contar con la que habría sido la primera computadora electro-mecánica de la historia y dado que la original fue destruida en los bombardeos de Berlín en 1943.

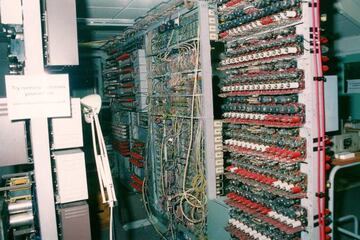

Se cedió a Zuse tecnología, personal universitario y fondos ilimitados para el proyecto y, tras dos años de trabajo y 800.000 marcos gastados, Zuse reprodujo su Z1. La computadora consta de nada menos que 30.000 componentes, algunos de ellos recuperados de la Z1 original de 1938, supera los mil kilos de peso y sí, esta vez funciona perfectamente. Sus “specs” son también historia. Con un ciclo u operación por segundo podríamos decir que su velocidad es de 1 Hz. Para realizar una suma requiere de tres ciclos de reloj, más los ciclos necesarios para leer y escribir en la memoria, con lo que el tiempo total es de cinco segundos. Una resta requiere cinco ciclos de reloj, una multiplicación dieciséis y una división dieciocho.

Si alguna vez viajáis a Berlín y tenéis la oportunidad de visitar su Museo de Tecnología, podréis ver esta Z1, la reproducción fabricada por el propio Zuse. Solo viendo este auténtico monstruo se pueden poner en valor la tenacidad de Zuse y su determinación para llegar a aquello desde la nada. Y todo por querer ahorrarse unas cuantas operaciones matemáticas en el trabajo…

Konrad Zuse falleció en Hesse en 1995, pocos meses después de publicar su libro “La computadora – Mi vida”. En esta ciudad se levantó una escultura como humilde homenaje al padre de la computadora que, tristemente, no ha logrado el reconocimiento que otros personajes posteriores han alcanzado al otro lado del Atlántico.

Porque en Estados Unidos, mientras Zuse ensamblaba relés en el desván de sus padres, otro ingeniero búlgaro buscaba el mismo objetivo, una máquina automática de computación, en el sótano de una universidad. Se trataba de John Atanasoff, al que también se atribuye la paternidad de las computadoras, sobre todo en Estados Unidos, donde realizó su investigación.

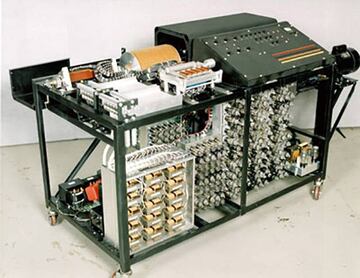

La tecnología de Atanasoff se basó en la utilización de tubos de vacío en sus circuitos lógicos y circuitos electrónicos, alcanzando un nivel de sofisticación muy superior a la Z1 de Zuse y tan solo cuatro años después, en 1942. Atanasoff, junto con un recién licenciado Clifford Berry construyeron una máquina realmente revolucionaria implementando por primera vez tres conceptos que se han mantenido desde entonces en las computadoras: El funcionamiento totalmente electrónico, prescindiendo por primera vez de engranajes, relés y piezas mecánicas, el uso del lenguaje binario (de 0 y 1) y la disposición de una memoria regenerativa que se complementaba con el sistema de computación.

Atanasoff desconocía el trabajo que a miles de kilómetros de distancia mantenía Zuse. Su computadora fue presentada en 1942 con el nombre de ABC (Atanasoff Berry Computer) y era radicalmente diferente a la del alemán en su concepción. Ésta constaba de algo menos de 300 tubos de vacío y casi dos kilómetros de cable, con un peso de 320 kg. Pese a su menor tamaño, la ABC era capaz de resolver mucho más que las cuatro operaciones básicas de la máquina de Zuse, consiguiendo realizar ecuaciones de hasta 29 variables. No obstante, no era del todo infalible, lo que impidió que fuese adoptada como herramienta de trabajo por los ingenieros para los que había sido diseñada y que habían financiado su construcción. Sin duda Atanasoff podría haber corregido estas deficiencias pero, al igual que ocurrió con Zuse, la Segunda Guerra Mundial truncó sus desarrollos. Una reproducción de la ABC de Atanasoff se construyó para ser expuesta en la universidad en cuyo sótano fue construida la original, en Iowa. En el siguiente vídeo podéis ver el funcionamiento explicado (en inglés) de esta réplica.

La casualidad tuvo el capricho de que ambos creadores de la computadora fallecieran con tan solo unos meses de diferencia, en 1995, con toda seguridad satisfechos al observar cómo su creación ya había sido determinante para esta civilización y se confirmaba como una de las invenciones más importantes del Siglo XX.

¡Todo vale por la patria!

Si bien hoy día prácticamente no se duda de los meritorios avances tecnológicos tanto de Zuse como de Atanasoff, no es difícil encontrar fuentes que atribuyen la invención de la computadora a otra persona, el norteamericano John W. Mauchly.

Mauchly fue un profesor de física universitaria que, mientras Zuse y Atanasoff montaban sus primeros relés y válvulas de vacío, daba clases en la universidad de Filadelfia. En 1941 una publicación científica alude al desarrollo de Atanasoff como al de una maravilla tecnológica capaz de resolver complicados cálculos algebraicos en segundos. En ese periodo Mauchly se estaba especializando en ingeniería militar y no tardó en advertir el potencial de una maquina como la descrita en los cálculos que exigía la tecnología balística de la época, en un momento en el que la Segunda Guerra Mundial se percibía como inminente.

Inmediatamente Mauchly contactó con Atanasoff y tras unos meses de contacto viajó a Iowa, al mismo sótano donde éste desarrollaba su ABC. Por aquel entonces el prototipo era funcional y Atanasoff era consciente de su potencial, por lo que, acertadamente, decidió patentarlo. Lo que no fue acertado fue delegar esa gestión en la universidad en la que trabajada, dado que, por una razón u otra, esa patente no se llegó a realizar. Esta dejación generaría una de las polémicas sobre propiedad intelectual más interesantes del siglo XX, como ahora veremos.

Atanasoff continuó con el desarrollo de ABC, una tecnología que creía protegida mediante una patente inexistente, mientras que Mauchly le visitaba periódicamente para admirar sus progresos y discutir sobre posibilidades de mejora.

Durante ese tiempo Mauchly nunca le reconoció a Atanasoff que había iniciado su propio desarrollo de una computadora. No le habló de los contactos que había mantenido con la armada estadounidense y cómo había convencido a los militares de lo revolucionaria que resultaría esta tecnología una vez aplicada al ámbito militar, como tampoco le comentó que estaba recibiendo de estos financiación sin límite y cualquier logística que necesitase en el desarrollo de esa máquina capaz de calcular con precisión la balística de bombas, obuses y torpedos.

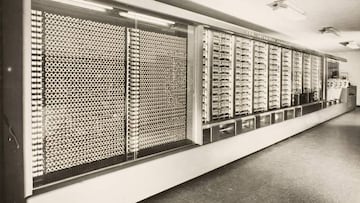

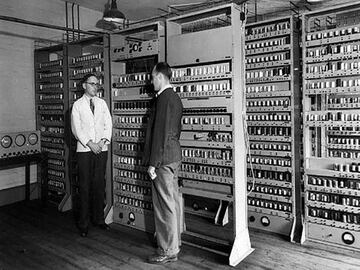

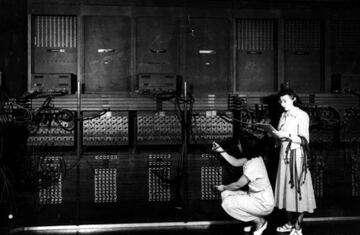

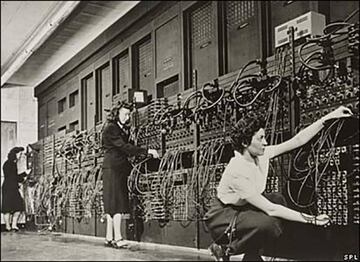

Mauchly, urgido por los militares ya en plena Segunda Guerra Mundial, se vio obligado a construir un modelo operativo de su proyecto. Sería ENIAC, acrónimo de Electronic Numerical Integrator And Computer, cuya fabricación comenzó en 1943 y fue finalmente entregada a la armada en 1946. ENIAC precisaba de un pequeño pabellón para su instalación, dado que tenía una longitud de treinta metros y pesaba 27 toneladas, ocupando la friolera de 167 m2. Contaba con 167.000 tubos de vacío y millones de condensadores, relés, resistencias… Su potencial era asombroso para la época, lo cual justificaba la financiación y construcción de este monstruo. Sin embargo requería de un esfuerzo tremendo para ser operada. Su consumo eléctrico superaba al de una pequeña ciudad de la época y requería una refrigeración constante para evitar que se fundiera.

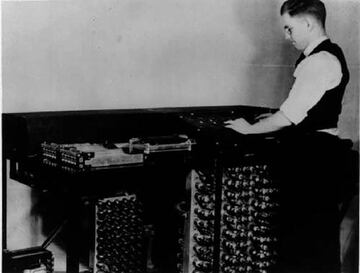

No obstante las mayores dificultades llegaban a la hora de programar la ENIAC para las funciones que se le demandaban. Esto requería operar sobre más de 6000 interruptores en un proceso que se prolongaba durante varios días. Cualquier error en este proceso daba al traste con los resultados conseguidos, totalmente centrados en el cálculo de balística militar. La programación o, dicho de otro modo, la auténtica razón por la que la ENIAC servía para algo, corría a cargo de seis mujeres que fueron seleccionadas entre las mejores matemáticas para esta función tan secreta como militarmente determinante.

En este punto muchos de vosotros que quizá no conocías la ENIAC y este tipo de “mega-computadoras” sí que tenéis referencias del uso de estas máquinas en la segunda Guerra Mundial gracias a otra historia mucho más conocida, la de Alan Turing.

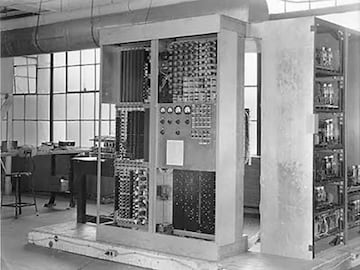

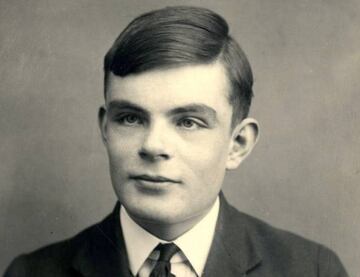

Turing, matemático británico, está considerado otro de los padres de la informática moderna, gracias a sus aportaciones en computación que quedaron desarrolladas en la conocida como Tesis Chuch-Turing. Sin embargo Turing es mucho más reconocible por haber utilizado una de estas proto-computadoras en la Segunda Guerra Mundial para descifrar las comunicaciones alemanas encriptadas mediante el sistema Enigma. Esta encriptación permitía 10.000 billones de variantes, con lo que era materialmente indescifrable. O así lo fue hasta que se cruzó con Alan Turing y su computadora Colossus.

La Colossus contaba con una programabilidad limitada y totalmente dirigida a la decodificación de mensajes. Físicamente era mucho más pequeña y fácil de operar que ENIAC, dada su especialización en este tipo de tarea. Turing, junto con su correspondiente equipo de mujeres matemáticas, consiguió descifrar el “código enigma” y no son pocos los que atribuyen a este logro, el de vulnerar por fin las comunicaciones alemanas, como paso decisivo hacia la victoria final aliada.

Si aún no lo habéis hecho, os recomendamos el visionado de la oscarizada película “The imitation game”, que recoge con bastante credibilidad este episodio histórico. Por otra parte, fuera del ámbito computacional y criptográfico, se recuerda a Turing por la negación que sufrió de sus logros y el acoso que sufrió, pese a ellos, por su condición de homosexual. Esta sexualidad era ilegal en el Reino Unido y Turing fue juzgado y condenado a la castración química por su condición sexual, lo que le produjo daños, tanto físicos como emocionales, irrecuperables.

Turing cedió a este acoso homófobo y acabó suicidándose mordiendo una manzana con cianuro, aunque no son pocos los que sostienen la teoría de que no fue él quien inyectó el veneno y que fue, por tanto, asesinado. Tenía solo 41 años. Si bien nunca se ha confirmado oficialmente, la manzana mordida que usa Apple como logo es un homenaje a la vida e injusta muerte de este gran matemático.

Volviendo a Estados Unidos, la ENIAC y Mauchly, mientras esta computadora se construía, su creador, consciente de sus posibilidades de mejora, ya diseñaba su segunda versión, bautizada como EDVAC.

En el desarrollo de EDVAC Mauchly recibiría la ayuda de un matemático húngaro que había emigrado a Estados Unidos huyendo de la persecución nazi a los judíos, John von Neumann. Neumann pasaría a la historia por dos cosas. Una de ellas es su participación en el conocido Proyecto Manhattan, desarrollando el método de implosión de la bomba atómica, arma que pondría un luctuoso final a la Segunda Guerra Mundial tras matar a cerca de cuatrocientos mil civiles entre Hiroshima y Nagasaki.

Sin embargo su aportación positiva a la historia llegó con la arquitectura de computadoras bautizada con su nombre, Arquitectura de Von Neumann. Esta arquitectura establece ya las bases de la computación tal y como la conocemos hoy, con un procesador, memoria RAM, unidades de almacenamiento y dispositivos de entrada y salida.

Von Neumann hizo pública su arquitectura, recibiendo una excelente acogida entre los cada vez más numerosos desarrolladores que apostaban por la computación digital, siendo adoptada por la gran mayoría de los mismos. Sin embargo omitió el origen de sus teorías y la más que probable participación de Mauchly en las mismas.

De este modo Mauchly se encontró en una pugna con Von Neumann por la propiedad intelectual de la arquitectura bautizada con el nombre de éste, mientras que por otro lado Atanasoff le reclamaba a él prácticamente lo mismo, denunciando su apropiación de los conceptos del ABC que presentó como propios al ejército norteamericano para procurarse el encargo y construcción de su computadora ENIAC.

Para mitigar estas penas tenía el gran éxito que supuso el funcionamiento de su segunda computadora, la EDVAC, que estuvo operativa para los militares norteamericanos entre 1951 y 1961, proporcionando un gran rendimiento y fiabilidad y, sobre todo, convenciendo definitivamente a los militares de que las computadoras eran un elemento imprescindible.

A modo de curiosidad decir que la fiabilidad de EDVAC sí que se vio comprometida al menos en una ocasión. En uno de sus largos procesos de cálculo ofreció unos resultados absurdos, propios de una avería. Los técnicos repasaron los miles de componentes y kilómetros de cable sin hallar la causa del error, hasta que una de las matemáticas que programaban EDVAC, la Oficial Grace Murray Hopper, descubrió una polilla aplastada bajo uno de los relés. Su frase de “Solved, it was a BUG” daría origen a que a partir de entonces, a cualquier problema informático, se le denomine como “bug”, bicho.

Mauchly vio complicada aún más su carrera de conflictos por la propiedad intelectual y patentes tanto de ENIAC, como de EDVAC, que finalmente acabaron con la invalidación de la patente del primero en 1973, treinta años después de su creación. La patente de ENIAC fue anulada por la Corte Federal de Estados Unidos al considerar que esta computadora se fundamentaba en los conceptos, documentación y prototipos que Atanasoff mostró a Mauchly sin ser conocedor las intenciones de este último de desarrollar su propia computadora con fines militares. Si bien esta sentencia debería poner fin a la controversia entre las propiedades intelectuales de Atanasoff y Mauchly, los argumentos de este último tienen suficiente consistencia para que no pocos defiendan que efectivamente es uno de los padres de la computación, desarrollando su trabajo mucho más allá de lo que Atanasoff podría haber avanzado.

Por supuesto el trabajo del pobre Konrad Zuse no ha sido valorado hasta muy recientemente, enterrado, como tantas otras tecnologías alemanas, en la turbulenta postguerra de un país castigado por la provocación y posterior participación en la Segunda Guerra Mundial.

Los albores de la era moderna. Ahora la lucha es por el negocio.

Como hemos visto, los genios que la parieron la computación alternaban sus cálculos sobre válvulas de vacío y transistores con los propios de crear la bomba atómica, bombardear Berlín o descifrar las comunicaciones de los U-boot. La tecnología había llegado a un punto en el que en distintos puntos del planeta varios genios asumieron qué se podía hacer y cómo hacerlo, poniéndose manos a la obra.

En desacuerdo con el clásico setentero “War” de Edwin Starr en el que gritaba “Guerra ¿para qué es buena? Absolutamente para ¡NADA!”, hemos de reconocer que un mundo que se recuperaba de la Primera Guerra Mundial y se sabía abocado a una Segunda, fue un terreno abonado para que las computadoras pudiesen ser “rentables”. Sin la inversión de cientos de miles de dólares de los militares, proyectos como ENIAC o Colossus no podrían haber dejado de ser más que otro de esos proyectos de científico chiflado. Con su utilidad militar, un gran interés (y presupuesto) gubernamental y numerosos científicos y universidades interesados en hacerse con él, la tecnología de la computación creció de forma exponencial en unos pocos años, en una carrera mucho más veloz de la que hemos sido testigos en nuestra generación, que no es poco.

Por hacer una última referencia a aquellos genios de los años cuarenta, decir que Mauchly, harto de problemas de patentes y licencias, dejó el desarrollo de nuevas computadoras. También hay que decir que parte de esa decisión se la hizo tomar la universidad de Moore, en la que trabajaba, al exigirle cobrar parte de las patentes de sus desarrollos. De este modo Mauchly volvió a su actividad docente.

El verano de 1946, Mauchly y sus colaboradores durante el desarrollo de ENIAC, Eckert y Goldstine, expusieron en la citada universidad las ponencias tituladas “Teoría y técnicas por el diseño de ordenadores digitales”. Entre los asistentes había una gran cantidad de técnicos de una empresa que lo cambiaría todo. IBM

And the winner is... IBM.

Antes de pasar página a unos años tan importantes como los narrados páginas atrás, debemos reconocer que nuestro recorrido por ellos ha sido simplificado al máximo, procurando evitar una lectura demasiado aburrida. Este objetivo no justifica que hagamos lo mismo que la historia ha hecho injustamente con personajes como Zuse o Turing y es que nosotros hemos omitido a decenas, centenares de personas que en estos años resultaron determinantes para el nacimiento y desarrollo de la computación.

Hemos omitido a Charles Baddage y a su compañera Ada Byron, hija del poeta inglés Lord Byron, que ya en 1830 establecieron los principio de la computadora digital, si bien la tecnología del siglo XIX les impidió llevarla adelante. Omitimos a Francés Joseph-Marie Jackard, que ideó el sistema de tarjetas perforadas en el que Zuse basó su trabajo. También a Herman Hollerit, la primera persona que demostró la utilidad real de las computadoras en el procesamiento de datos con sus logros censando la población. De Hollerit hay que añadir que creó su propia empresa de censo y computación que acabaría siendo una de las tres patas sobre las que se levantaría IBM… Todos ellos son considerados también como padres de la informática. Intentaremos disculparnos por todas esas omisiones volviendo a insistir en que el nacimiento de la computadora no puede ser considerado como un hecho puntual, ya sea en un momento o lugar concreto, ya que es producto de la interacción, intencionada o no, de distintas personas, en diferentes países, con aportaciones más o menos complementarias, que fueron convergiendo hasta que por fin, alguien supo conseguir aquello que realmente ha hecho posible que ahora mismo todos estemos frente a una computadora: la normalización de la informática. Hablamos de IBM.

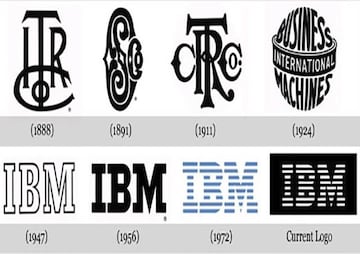

Nos atrevemos a apostar a que muchos de vosotros, antes de la lectura de este reportaje, a la pregunta de quién inventó el ordenador personal respondería que IBM. La realidad es que IBM no inventó nada. O al menos no lo hizo en aquellos primeros años. La compañia se crea en 1911 como una especie de “joint venture” en la que varias empresas acuerdan unirse como estrategia para potenciar la penetración de sus productos. Las empresas fundadoras aportaban sus patentes, entre las que estaban la escala de computación, el dial de grabación, la máquina eléctrica de grabación o la computación censal del ya citado Herman Hollerit. De hecho el principal servicio que pretenden ofrecer gira alrededor de la tabulación automática de datos, censos, como indica el nombre que adoptan: Computing Tabulating Recording Corporation, o CTR. No sería hasta 1924 cuando adoptan un nombre más general, como es sin duda International Business Machines, o IBM.

En principio la compañía, que se establece en Nueva York, abarca la producción de maquinaria que automatizaba tareas, desde el cómputo de frutas, a las primeras máquinas automáticas o robots primigenios que ayudaban en la industria. Sin embargo la mayor apuesta de IBM siempre fue la computación y el procesamiento de datos. Su primer presidente Thomas J. Watson, supo captar la atención del gobierno norteamericano ofreciéndole la capacidad de censar y mantener registros de toda su población, obteniendo contratos millonarios.

Las iniciativas de IBM respecto a las computadoras inicialmente chocaron con el problema de que precisamente no eran eso: iniciativas. Sus desarrollos partían de los avances de genios como los citados Zuse y Atanasoff, construyendo computadoras que pretendían competir con las de estos en un momento en el que llegar un año tarde suponía, al igual que ahora, estar completamente obsoleto.

Sin embargo IBM contaba con dos cosas que no tenía la competencia. Por un lado un gran presupuesto, que no dejaba de engordar gracias a sus equipos de tabulación de datos, y por otro, una gran plataforma empresarial que seguía creciendo y ganando posibilidades.

Así, sus primeras computadoras, si bien no fueron ni las primeras, ni las más avanzadas, fueron las más accesibles y pronto empezaron a ganar espacio. Mientras Zuse iba vendiendo sus primeras Z4, de una producción limitadísima, IBM podía proporcionar computadoras similares, basadas primero en interruptores electromecánicos, luego en válvulas de vacío, de forma más rápida y barata. Mientras Mauchly proporcionaba a la armada norteamericana su ENIAC, o Turing programaba sus Colossus para la británica, IBM proporcionaba sus computadoras utilizadas para funciones secundarias. Nunca iban por delante, pero siempre estaban ahí, disponibles. Y así fue hasta que tomaron la iniciativa. Una iniciativa que ya no soltarían en varias décadas.

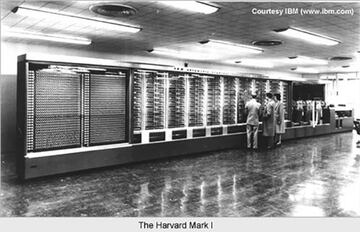

Las primeras computadoras de IBM se bautizaron como MARK I. Efectivamente es el mismo nombre del primer carro de combate de la historia o de la primera armadura de Ironman. Las Mark I fueron concebidas como un encargo militar del gobierno norteamericano, al que IBM surtía de la más variada producción, desde la consabida maquinaria censal, a los fusiles automáticos Browning o la famosa carabina M1.

La armada requería más computadoras y entraron en producción las MARK II y las MARK III, llegando a la década de los cincuenta con una producción casi totalmente volcada en esta rama del negocio. Es a partir de este momento en el que IBM se convierte en decisiva en el desarrollo de la informática.

A los vetustos Mark les sustituyen los primeros IBM. El IBM 701 seguía teniendo fines militares y se basaba en válvulas de vacío, pero por fin el tamaño de una computadora era inferior al de un coche. Detrás de él llegaron el IBM 650 y en 1956 se presenta el IBM 704.

Esta computadora, el 704, la vamos a coronar como el primer “PC Gamer” de la historia, dado que permitía jugar con él a las damas. Dejando a un lado las bromas, el 704 resultó paradigmático porque fue la primera computadora capaz de “aprender” de las operaciones de realizaba. Podríamos considerarlo como el nacimiento de lo que ahora conocemos como Inteligencia Artificial.

A partir de este momento las aportaciones de IBM a la industria se convierten en estándares a implementar. En 1957 desarrollan un sistema de almacenamiento en disco. Habían inventado el disco duro, con una tecnología idéntica a la que aún hoy mantenemos en nuestros PC.

En 1959 IBM abandonó definitivamente las válvulas de vacío apostando por los transistores, siendo la primera compañía en comercializar computadoras completamente basadas en esa tecnología. El primer ordenador de transistores sería el IBM 7090, que también será recordado como la primera computadora se salió de los límites militares y de investigación, para adentrarse en el ámbito empresarial. No podemos hablar aún de una adopción de la computadora en el mercado privado, dado que se vendieron unas trescientas unidades de estos IBM. Y no nos parecen pocas, teniendo en cuenta que cada una costaba unos tres millones de dólares.

IBM mantuvo su tendencia de hacer cada vez computadoras más “asequibles”, dentro de lo visto hasta entonces. Pero lo que realmente hicieron mejor fue saber ocupar vacíos antes siquiera de que se generaran; de cubrir necesidades que hasta entonces no se habían tenido en cuenta. Supieron surtir de soluciones a industrias como la aeronáutica, la marítima, dando un salto de imagen y prestigio definitivo al estar constantemente presentes en el mayor hito de esta civilización hasta la fecha, la conquista del espacio, los viajes a la Luna. La NASA no se concebiría sin IBM y estos se ocuparon de que todo el mundo, literalmente, lo supiera. Mientras todas las televisiones del mundo retransmitían imágenes del control de Cabo Cañaveral, lo que toda la humanidad veía era a personas como ellos haciendo cosas increíbles gracias a unas máquinas con un logo de tres letras: IBM.

Mientras tanto seguían con sus aportaciones tecnológicas. En 1968 presentan la memoria RAM, en módulos, tal y como ahora la conocemos. Aquella DRAM (Memoria Dinámica de Acceso Aleatorio) se basaba en el uso de transistores y condensadores, exactamente igual que lo hace ahora.

En esa época IBM ya había abandonado cualquier otra actividad empresarial ajena a la informática. En 1964 lanzan el System/360 que sería la primera computadora capaz de intercambiar periféricos y programas con otros equipos de la misma tecnología. Había nacido el primer “compatible”. La tecnología estaba lanzada ya hacía el PC que ahora conocemos.

Tal era el éxito de IBM que en 1969 hablar de una computadora era hablar de IBM. Sencillamente no había más. No tenían competencia porque su inversión en desarrollo y potencial de fabricación hacia absolutamente imposible que otra compañía pudiera disputarles parte del pastel. Es por esta razón que la corte norteamericana juzgó a la compañía por monopolio, por ejercer una posición absolutamente dominante en el mercado. Este proceso judicial se prolongó por nada menos que catorce años, hasta 1973, y poco se puede extraer de él, salvo que IBM aprendió muy bien cuáles debían ser sus límites en una batalla por el mercado en la que, aún hoy, sigue inmersa.

Mientras tanto la compañía seguía creciendo, inventando, extendiéndose. En 1971 inventaron el disco flexible como soporte de almacenamiento portátil. Continuaron con la invención de los lectores ópticos y magnéticos, pariendo tecnologías como las de bandas magnéticas y códigos de barras o BIDI.

Este crecimiento se mantuvo sostenido gracias a una cada vez mayor producción de computadoras. Ya habían salido definitivamente del ámbito militar y universitario y comenzaban a ganarse el que sería su soporte durante las décadas venideras, el empresarial. Aún era muy complicado que alguien tuviera una computadora en casa, pero al menos esa posibilidad existía. En las universidades, en la empresa, en las instituciones; los ordenadores se estaban extendiendo. IBM había conseguido que la informática, que las computadoras, finalmente se normalizaran.

Aunque para que eso definitivamente ocurriera debemos esperar hasta 1981, el año en el que IBM lanza IBM PC, el Personal Computer. Había nacido el PC. La computadora que hoy reconocemos. La computadora entra por fin en los hogares. Y con ello su aplicación más lúdica, los videojuegos. Llega el hardware dedicado, el hardware “gaming”, una parte de nuestra historia, ya reciente, que dotará de contenido a las siguientes entregas de este reportaje especial. Eso, queridos amigos, es otra historia que también será contada.

Parte 1: Una criatura con varios padres.

Parte 2: IBM, Apple y Microsoft