¿Cómo reaccionarías en un accidente de tráfico? Esta web te pone a prueba

¿Salvarías a los que van contigo? ¿Atropellarías a un adulto en vez de a un niño?

Quien haya experimentado alguna vez el horror que supone tener un accidente de tráfico siendo el conductor, sabe que la decisión de dar una tacada de freno o girar el volante se produce en décimas de segundo. Pero hay casos extremos en los que además de los reflejos o la experiencia entra en juego un elemento tan subjetivo como es el sentido de la moral del propio conductor. Y esto es precisamente lo que esta web pone a prueba con un particular test moral relacionado con el Tráfico y la circulación llamado la Máquina Moral.

La Máquina Moral

Desde los vehículos autónomos en vías públicas hasta los cohetes reutilizables no tripulados que aterrizan en buques autónomos, las máquinas inteligentes están apoyando o asumiendo actividades humanas cada vez más complejas a un ritmo creciente. Y por más que el escenario ‘Skynet’ que planteaba el film Terminator aún parece por fortuna lejano, la mayor autonomía dada a las máquinas inteligentes en estos papeles puede llevar a situaciones en las que éstas tengan que tomar decisiones de manera autónoma que afectarán a la integridad física de humanos en una época en que no tenemos las tres Leyes de la Robótica de Isaac Asimov implementadas del todo.

Tesla Motors, Uber y otras son compañías que están trayendo la conducción autónoma a los vehículos, y también hemos visto ejemplos de transporte urbano automatizado. Pero ¿qué sucedería si una máquina tuviese que elegir entre dos factores dentro de un contexto de accidente, siendo el A por ejemplo estrellarse contra la mediana y el B atropellar a ciudadanos? Esto requiere, no sólo una comprensión más clara de cómo los seres humanos toman tales decisiones, sino también una comprensión más clara de cómo los seres humanos perciben la inteligencia de la máquina tomando tales decisiones.

Este es precisamente el objetivo de la Máquina Moral, una plataforma creada por el prestigioso MIT para recopilar “una perspectiva humana sobre las decisiones morales tomadas por las máquinas inteligentes”, como son los coches autónomos. A través de un test veremos dilemas morales en forma de escenarios en los que un coche sin conductor debe elegir el menor de dos males, como elegir si es más factible chocar y matar a dos pasajeros que llevamos en el coche o por contra salvarlos a costa de atropellar y matar a cinco personas. ¿Valen más las vidas de los ocupantes del vehículo que las de personas desconocidas? ¿Es mejor morir chocando contra un quitamiedos que vivir si ello implica atropellar a un anciano?

¿Cómo reaccionarías en un accidente de coche?

Noticias relacionadas

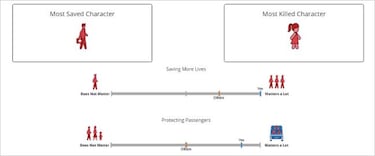

Como observadores externos, nos toca juzgar cuál es el resultado que consideraríamos más aceptable. Cada escenario nos plantea un dilema moral diferente, y si por lo que sea no entendemos la imagen descrita, el comando Mostrar Descripción nos aclarará la prueba. Al terminar veremos una serie de estadísticas que describirán nuestro comportamiento en base a elementos como si obedecemos las normas, si tendemos más a proteger a un grupo de edad o género específico antes que a otro, si nuestra decisión se basa más en factores puramente de cifras que morales, etc.

Un elemento ciertamente curioso es la posibilidad de comparar respuestas y estadísticas con miles de usuarios de todo el mundo, viendo lo variado que es el propio comportamiento humano y cómo en tal o cual sociedad puede estar más o menos influenciado. Si queréis hacerlo, basta con entrar aquí y darle al botón adecuadamente llamado ‘Comenzar a Juzgar’.