Realismo interactivo

Los motores tridimensionales de última generación ponen al alcance del jugador mundos fantásticos de apariencia ultrarrealista. Siendo la tendencia visual más importante en la actualidad, una respuesta interactiva a la altura de este realismo formal se hace necesaria, como veremos a lo largo de este artículo.

La realidad, referente habitual en la representación de cualquier obra visual, muestra su infinito potencial interpretativo estableciendo las bases de la creación artística en todas sus vertientes. Su carácter efímero, ha necesitado siempre de la expresión artística y literaria para vencer los límites del tiempo. Pero la otra realidad, llevada más allá de lo tangible como filtración estética de la sicología humana, puede dar lugar a interpretaciones subjetivas que, en mayor o menor medida, acercan su concepción a las bases de la representación abstracta. Dicha tendencia reniega de la imitación exacta de la realidad para prestar más atención a problemáticas formales, compositivas y cromáticas. Estas vertientes pueden encontrarse, de forma muy reconocible, dentro de algunos mecanismos creativos que han marcado la evolución de los videojuegos. Sin embargo, la representación objetiva del entorno tridimensional, hoy en día, se presenta como la tendencia más importante en la dirección artística del sector interactivo.

La interpretación de la realidad en base a unos cánones artísticos concretos, fundados en las reglas marcadas por el conocimiento científico de la naturaleza, constituye uno de los pilares básicos de la creación plástica objetiva. El hiperrealismo en su vertiente artística, fomenta la producción de obras plásticas apoyadas en la representación naturalista de las formas, llevada hasta el extremo, pretendiendo emborronar la línea que separa la representación de la propia visión de la realidad. Una de las vertientes más importantes de este estilo artístico , el fotorrealismo -desarrollado a finales de los años 60-, utiliza las bondades de las cámaras fotográficas para reunir información visual, que posteriormente se usará como principal referente para la creación de la obra. Artistas como el americano Richard Estes, constituyen una referencia básica de la disciplina , cuya máxima se sitúa en utilizar el referente fotográfico en detrimento del natural.

/es/node/Array

Junto a esto, el Realismo Mágico es una tendencia nacida a mediados del siglo XX que, tanto en literatura como en pintura, pretende presentar lo fantástico e imaginativo como algo cotidiano, estructurado bajo un contexto fundamentalmente realista (situación que lo aleja del surrealismo), obteniendo una respuesta interactiva en los mundos quiméricos que encontramos en muchos videojuegos. A lo largo del artículo pretendemos abarcar la representación objetiva del contexto vectorial, profundizando en las características técnicas que definen muchas producciones realistas, sin dejar de lado uno de los aspectos más importantes del medio: las posibilidades inmersivas que permite la interacción del jugador con un entorno virtual. Aunque este estudio se concentra en la interpretación del realismo en videojuegos de última generación, comenzaremos con un repaso rápido de los diferentes aspectos que han marcado la evolución de los gráficos tridimensionales realistas, para contextualizar de forma coherente su posterior adaptación a los sistemas de entretenimiento que disfrutamos en la actualidad.

ESCULTURA TRIDIMENSIONAL REALISTA.

El término hiperrealismo comenzó a utilizarse en el terreno de la animación tridimensional de forma común, con el lanzamiento de películas como Toy Story o Final Fantasy: La fuerza interior. Los avances tecnológicos utilizados para la creación de entornos tridimensionales y personajes equivalentes en valores formales a la realidad, generó nuevos objetivos para el mundo de la imagen generada por ordenador. Gran parte del éxito de estas producciones lo propiciaron las herramientas de edición tridimensional, que permitían la construcción de modelos formados por millones de vectores, pudiendo editar tanto superficies orgánicas como inorgánicas con gran exactitud. El mundo de los efectos especiales por ordenador, se sirvió de estos avances en modelado orgánico para crear criaturas imposibles de realizar mediante otras técnicas. Jurassic Park o Jumanji aprovecharon estos avances para integrar los elementos generados por ordenador con el entorno filmado directamente de la realidad.

Sin embargo, la precariedad de los primeros motores tridimensionales no permitía que ese realismo formal pudiera ser trasladado al entorno interactivo, por lo que muchos títulos optaban por la ejecución de escenas pregrabadas generadas por ordenador para narrar determinados acontecimientos. La geometría en estos vídeos se disparaba de forma desorbitada, lo que incurría en una desconexión total entre las escenas in-game y las CG. A partir del lanzamiento de la generación de consolas de 128 Bits, junto al avance de los motores tridimensionales en PC, los modelos vectoriales en videojuegos como Silent Hill 2, Doom 3 o Final Fantasy X empezaron a utilizar cánones geométricos muchísimo más complejos. De esta forma, el modelado de rostros realistas en tiempo real se hizo realidad. No obstante, la frontera instaurada por las herramientas utilizadas en escenas generadas por ordenador, se vislumbraba aún en la lejanía. Por su parte, los escenarios ganaron en cantidad y calidad de detalles en sus acabados, mientras la escala de los mismos llegaba al calificativo de colosal, en títulos como Grand Theft Auto: San Andreas o The Elder Scrolls III: Morrowind.

MAPEADO VECTORIAL.

Una de las bases fundamentales en la búsqueda del realismo, radica en la edición de texturas para el mapeado de modelos tridimensionales. Un aspecto destacable de la película Final Fantasy: La Fuerza Interior, radicaba en la edición de variadas texturas que imitaban de forma hiperrealista las cualidades de diferentes superficies. De esta forma, la representación de la piel de cada uno de los protagonistas, mostraba los pliegues, imperfecciones y cualidades propias de un ser humano real. No obstante, esta representación no fue un triunfo total, ya que propiedades como la elasticidad y la translucidez de los diferentes tipos de superficies cutáneas fueron trasladadas al entorno vectorial con un índice de éxito menor. Problemas derivados de la extrema complejidad con la que se presenta la realidad ante nuestros ojos, se han visto superados en gran medida, como pudimos comprobar en el lanzamiento de películas como Beowulf o El curioso caso de Benjamin Button. Aunque la representación de entornos tridimensionales ha alcanzado prácticamente la madurez, el terreno de la edición de personajes humanos hiperrealistas se ve mermado por la complejidad individual que nos caracteriza.

Para el mapeado de modelos vectoriales en tiempo real, la utilización de fotografías digitalizadas para imitar las cualidades de variadas superficies y la edición de texturas mediante herramientas infográficas, dio unos resultados bastante realistas en títulos como Shenmue o Metropolis Street Racer. Mientras la mayoría de texturas mostraban un aspecto pixelado o borroso durante la generación de los 32/64 Bits, el significativo incremento de la potencia en los sistemas de 128 Bits facilitó la inclusión de un texturizado más complejo y realista. Para la representación de superficies reflectantes, las texturas multi-capa utilizadas en Gran Turismo 1 y 2 de Playstation, se sustituyeron por mapas especulares que reflejaban el entorno en tiempo real, como pudimos comprobar con el lanzamiento de Gran Turismo 3. Además, la adaptación de efectos volumétricos como el Bump Mapping al terreno de representación interactivo, dio resultados más que satisfactorios en títulos como Halo y Doom 3. El resultado de estos avances, se vio reflejado en el diseño de los personajes de Silent Hill 3, así como en el realismo de espacios escénicos interactivos como Ciudad 19, de Half Life 2.

EFECTOS DE ILUMINACIÓN, AMBIENTALES Y DE POST-PROCESADO

Las herramientas de modelado y texturizado tridimensional, muestran su idoneidad a la hora de representar los entornos y personajes vectoriales de una producción interactiva bajo una concepción visual realista. No obstante, la recreación de un apartado gráfico atractivo en videojuegos, pasa por la adecuación de todos sus elementos dentro de un conjunto final sólido. Para ello, definir una ambientación inspirada en factores recurrentes de la realidad es un aspecto muy a tener en cuenta. Los motores de iluminación avanzados utilizados en el mundo del cine, generan ambientes prácticamente reales, viendo sus bondades adaptadas al sector de la animación tridimensional. Además de esto, complejos sistemas de partículas permiten gestionar efectos ambientales como polvo o humo, cambios atmosféricos e interpretaciones de diferentes fluidos, generando espacios escénicos vectoriales de gran complejidad.

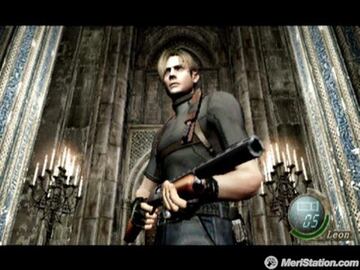

No obstante, los motores utilizados para la representación de escenarios vectoriales en tiempo real, han tenido serios conflictos para intentar gestionar sistemas de iluminación creíbles. Mientras que en The Legend of Zelda: Ocarina of Time, pudimos disfrutar con fuentes de iluminación dinámicas, el salto de generación permitió que esas fuentes generaran sombras arrojadas en tiempo real al iluminar los objetos y personajes del espacio escénico vectorial, como pudimos comprobar en Silent Hill 2. Por otra parte, la integración de distintos efectos visuales y la representación de cambios atmosféricos en tiempo real, supuso el éxito visual de títulos como Resident Evil 4, cuyos recursos gráficos mostraron la importancia de una buena ambientación para la interpretación de distintos espacios interactivos. A pesar de estos avances, las posibilidades de los motores de iluminación compleja quedaban lejos de ser adaptadas al entorno gestionado en tiempo real. Junto a ello, la interpretación vectorial de elementos fluidos, mediante la utilización de sistemas de partículas, permanecía en lo más profundo de nuestros sueños.

LA ACTUALIDAD DE LA REPRESENTACIÓN INTERACTIVA.

Muchos de los efectos de iluminación global y algunas de las simulaciones realizadas mediante sistemas de partículas, utilizados de forma habitual en animaciones generadas por ordenador, siguen sin tener un reflejo equivalente en el mundo de los videojuegos. Además de ello, la carga poligonal necesaria para gestionar multitud de detallados elementos simultáneamente en pantalla, sigue estando limitada por la potencia de los engines gráficos actuales. No obstante, los recursos que permiten los nuevos motores de gestión poligonal, confieren un realismo visual al entorno interactivo que, en algunas ocasiones, se sitúa por encima del mostrado en escenas generadas por ordenador producidas hace algunos años. Esto, unido a las particularidades de ciertas herramientas de edición poligonal, que permiten la simulación de un escenario iluminado de forma global y la gestión de texturas que generan la ilusión de mayor carga poligonal en determinados elementos, desemboca en una situación extremadamente atractiva para el diseñador de entornos tridimensionales realistas.

MODELADO DE ÚLTIMA GENERACIÓN

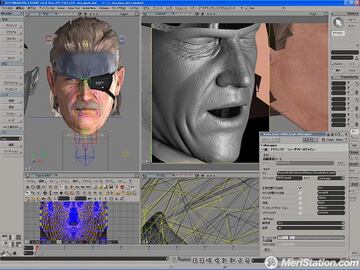

En la actual generación de consolas y ordenadores, los últimos motores de gestión poligonal permiten un modelado mucho más complejo; la geometría utilizada para el diseño de personajes en títulos como Uncharted: El tesoro de Drake o Mass Effect, se traduce en resultados visuales impresionantes. Para hacernos una idea, Solid Snake, protagonista de Metal Gear Solid, contaba con una malla poligonal formada por 700 vectores. La cifra llegó hasta los 4.000 en la versión de este personaje diseñada para Metal Gear Solid 3: Snake Eater. El modelo de Old Snake que aparece en Metal Gear Solid 4: Guns of the Patriots eleva esa cifra hasta los 50.000. La calidad en el modelado de escenarios de la actual generación también ha subido exponencialmente, por lo que podemos disfrutar de emplazamientos cada vez más detallados, abarrotados de elementos secundarios diseñados por separado.

Los exteriores selváticos del videojuego Crysis, muestran una representación de elementos orgánicos de una complejidad enfermiza, definidos bajo un potente editor de modelado tridimensional. La recreación de personajes sigue unos elevados cánones geométricos, completando escenas cuya carga poligonal hace temblar a las mejores tarjetas gráficas. Por su parte, en Grand Theft Auto 4 podemos ser partícipes de la representación más espectacular de un entorno urbano interactivo realista en consolas. Diseñada y estructurada bajo un modelo totalmente inspirado en Nueva York, Liberty City se reivindica como una metrópolis de increíble dinamismo, formada por la perfecta conexión de elementos genuinamente estáticos (edificios, puentes, carreteras) y modelos de naturaleza orgánica (desde la representación del agua hasta el modelado de los ciudadanos). El nutrido departamento de escultura digital de Rockstar North, trabajó incansablemente para modelar infinidad de elementos secundarios (cubos de basura, escombros, buzones, farolas, semáforos, postes eléctricos, carteles, árboles ) que completarían el espacio escénico interactivo ofreciendo una visión realista de un entorno urbano colosal, cuyos detallados emplazamientos se muestran sin ningún tipo de transición entre zonas. Gracias a este logro técnico, al visitar el interior de alguna edificación provista de ventanas, podemos observar a través de ellas el exterior de la ciudad, mostrada con todo lujo de detalles en tiempo real.

Por otra parte, el gran trabajo de modelado con el que cuentan los vehículos del videojuego de conducción Gran Turismo 5 Prologue, se traduce en unas cifras de escándalo. Cada coche está formado por unos 200.000 polígonos, lo que supone un salto considerable teniendo en cuenta que en Gran Turismo 4 utilizaban mayas poligonales de 5.000 vectores por vehículo como máximo. Gracias a ello, se han podido recrear modelos tridimensionales que cuentan prácticamente con todos los detalles de sus versiones reales, situándose como el referente a batir en cuestión de recreación realista de vehículos.

Las limitaciones de los motores tridimensionales, al generar espacios interactivos de geometría compleja plagados de efectos gráficos, desembocaron en la utilización de sistemas que evitaban la gestión poligonal innecesaria.

De esta forma, el denominado Deferred Rendering permitía representar solo lo que se encontraba dentro del campo de visión de la cámara en cada momento, evitando la generación de objetos -o parte de ellos- que escapaban de la visión del jugador, por medio de los chips PowerVR. Sus diferentes versiones se adaptaron a varias tarjetas gráficas y a la consola Dreamcast de Sega. No obstante, se lleva utilizado la GPU para el cálculo de las zonas que deben ser renderizadas desde hace mucho tiempo, tanto en PC como en consolas, proceso que requiere más recursos al no tener un chip específico para la resolución de este problema. Por su parte, la consola Playstation 3 consigue gestionar espacios escénicos vectoriales ahorrando la manipulación de geometría oculta y efectos que quedan fuera del campo de visión del jugador, utilizando las particularidades de su estructura interna. Para ello, asigna uno o varios de los 7 SPEs funcionales del procesador Cell para calcular qué elementos del entorno no deben ser renderizados, gestionando de forma inteligente la aplicación de efectos gráficos complejos. Aunque se consiguen buenos resultados, este proceso sigue utilizando bastantes más recursos que la técnica adaptada mediante los chips PowerVR.

PROGRESO EN EL TEXTURIZADO VECTORIAL.

El mapeado de elementos tridimensionales, puede considerarse un apartado técnico tanto o más desarrollado que el del modelado tridimensional en tiempo real. De hecho, muchas de las virtudes atribuidas al excelente modelado de personajes como Marcus Fenix, protagonista de la saga Gears of War, son en realidad producto de la ilusión generada por el complejo sistema de texturizado adaptado al modelo tridimensional. En Gears of War 2, se aprovechan los últimos avances del Unreal Engine 3, para la construcción de escenarios y personajes con alto grado de detalle, cuyas texturas hacen del ahorro poligonal su máxima prioridad. Una evolución del Bump Mapping, cuyo objetivo es el de añadir relieve o rugosidad a superficies lisas, la encontramos en las denominadas Texturas Parallax o Parallax Mapping. Esta técnica consigue recrear superficies con relieves complejos, mediante la gestión procedural de texturas que varían dependiendo del punto de vista de la cámara.

De esta forma, podremos observar dicho relieve desde distintos enfoques, viendo como se ocultan determinadas caras y se revelan otras, dando la sensación de ser una superficie modelada en tres dimensiones. Esta técnica, denominada también Virtual Displacement Mapping (Mapeado con Desplazamiento Virtual), fue investigada durante el año 2001 por Tomomichi Kaneko y otros científicos de prestigio, y se fundamenta en la descripción de una superficie a través del tratamiento procedural de la imagen, consumiendo menos recursos que los procedimientos basados en el modelado vectorial. Durante el año 2004, se desarrollaron ideas que permitieron añadir valores de oclusión ambiental y self-shadowing (auto-sombreado) a estas texturas, como podemos comprobar en el trabajo de personalidades como Natalya Tatarchuk, dando lugar al Parallax Occlusion Mapping. La aplicación de Mapeado Parallax al entorno interactivo va desde su representación en el videojuego de Rare Kameo, hasta su adaptación a entornos interactivos como los de The Elder Scrolls IV: Oblivion, Bioshock o Uncharted: El tesoro de Drake. Por su parte, podemos encontrar demostraciones de Parallax Occlusion Textures en muchas superficies recreadas para el videojuego Crysis. La inclusión de Relief Mapping en tiempo real aún no es muy común más allá de juegos punteros de PC y mods específicos, pero sus bondades permiten editar relieves complejos con una exactitud mayor que el Parallax Occlusion Mapping, manteniendo una gran fidelidad en los valores de oclusión y sombreado.

Para la edición de personajes con alto grado de detalle, la técnica de texturizado más utilizada en la actualidad la encontramos en el denominado Mapeado de Normales o Normal Mapping. Aunque no alcanza los mismos valores de complejidad que las Parallax Oclussion Textures, supone un salto abismal si lo comparamos con el Bump Mapping. Mientras estas texturas solo tienen en cuenta la simulación del valor altura, el Normal Mapping obedece también a cuestiones referentes a la anchura y la profundidad. Para diseñar personajes detallados sin que la carga geométrica sea excesiva, se utiliza como modelo de referencia una versión en alta resolución poligonal (cuyo acabado final pasa, de forma habitual, por una concienzuda edición en Z-Brush), para editar a partir de esos polígonos todo el mapeado de normales. Una vez que el resultado es el deseado, se adapta este texturizado al modelo de baja resolución vectorial. Gracias a esta técnica, se genera la ilusión de mayor carga poligonal (debido a que los Normal Maps modifican sus cualidades de forma procedural según la dirección de la luz y la posición de la cámara) y supone una herramienta de valiosa utilidad en el diseño de los personajes de juegos como Gears of War 2 o Clive Barker's Jericho.

Muchos de los títulos que han triunfado a nivel técnico, en la actual generación de sistemas de entretenimiento, utilizan los últimos avances en mapeado especular y sistemas de texturizado que controlan la difusión lumínica de las superficies. Al editar una textura cualquiera, orientada a su representación en tiempo real, los motores tridimensionales avanzados permiten controlar la especularidad y el grado de difusión lumínica de estos mapas, para representar superficies con mayor realismo. De esta forma, videojuegos de conducción como Gran Turismo 5 Prologue, muestran la importancia de la especularidad al editar superficies lustrosas (la carrocería de los vehículos), dando como resultado una representación encomiable, calculada en tiempo real, de todo lo que se refleja en ellas. Conseguir un resultado más realista pasa por la aplicación de texturas que tengan en cuenta las ecuaciones de Fresnel.

Según estas fórmulas, el comportamiento de la luz al actuar sobre una superficie especular varía en función del ángulo de incidencia de las ondas lumínicas, así como del ángulo de la cámara que muestra la escena. De esta forma, los reflejos en la carrocería de un coche representan el entorno de una forma monótona, sin cambios de intensidad, al no tener en cuenta las ecuaciones Fresnel. Después de la aplicación de estas fórmulas, el resultado se ve potenciado por unos reflejos más realistas, cuya sutileza varía dependiendo del ángulo de incidencia de la luz, así como de la situación de la cámara. Por su parte, la difusión lumínica representa el grado de absorción de luz con el que cuenta una superficie. Dependiendo de su valor, obtendremos un punto de luz máxima con mayor o menor definición. Además, la luz rebotará en esta superficie en diferentes direcciones -según sus características morfológicas- dando como resultado la contaminación lumínica de los objetos colindantes, que pueden ser bañados en mayor o menor grado por el color de la superficie originaria.

Para la representación de superficies con distintos grados de refracción (recordemos el típico ejemplo del lápiz dentro de un vaso con agua, que parece estar partido), es necesaria la edición de texturas que toman en cuenta el comportamiento de las ondas lumínicas, al entrar en contacto con una elemento cuyo índice de refracción es distinto. Para la recreación de agua realista en un entorno tridimensional, dotarla de un mapeado especular que represente de forma eficiente la transparencia y las cualidades de refracción y reflexión del líquido elemento, sería la solución ideal. Aún hoy, su aplicación al entorno realista es todo un desafío, dada la dificultad de utilizar sistemas de iluminación por Raytracing en tiempo real, aunque su simulación se hace posible gracias al trabajo de investigadores como Manuel M. Oliveira, por medio del aprovechamiento de Shaders específicos, como sucede con la representación de algunas superficies en el videojuego Crysis.

Por otra parte, las texturas totalmente procedurales pueden tener un futuro brillante a corto plazo. Estas texturas ocupan una cantidad ínfima de memoria, debido a que no son imágenes en si mismas (jpj, bmp, png), sino que se editan bajo líneas de código. De esta forma, su representación en el entorno interactivo pasa por su adaptación desde el historial que condujo a su creación. Además de ello, pueden generarse complejos algoritmos que representen superficies monótonas donde la textura no se repita nunca, dando como resultado una sensación más efectiva de realidad. No obstante, el control que el programador ejerce sobre ellas puede estar limitado, viendo la representación de determinadas superficies como una tarea muy difícil de abordar. A pesar de ello, la combinación de este método con los procedimientos de edición de texturas mediante herramientas como PhotoShop y Z-Brush, puede definir el futuro de la representación realista interactiva.

El aprovechamiento de diferentes tipos de texturas para completar la edición de un entorno tridimensional, es una herramienta básica en la búsqueda del realismo dentro del contexto interactivo, como demuestra el buen trabajo realizado en Bioshock. Sin embargo, el abuso de Parallax Textures y Mapas especulares pueden generar un resultado totalmente contrario a este principio, dando lugar a los acabados antinaturales de las superficies editadas para algunos videojuegos, que generan brillos por doquier o rebelan su origen bidimensional al emborronarse en la lejanía, hechos que se hacen notorios en determinados entornos del título de Rare Perfect Dark Zero.

ILUMINACIÓN AVANZADA Y EFECTOS ESPECIALES.

Uno de los obstáculos más difíciles de superar, en cuestiones de representación tridimensional en tiempo real, es el de conseguir una iluminación realista cercana a la gestionada para la elaboración de escenas generadas por ordenador. Calcular una iluminación global siguiendo los cánones establecidos por sistema de renderizado por Radiosidad es, hoy en día, imposible de adaptar a un entorno interactivo de forma literal. Sin embargo, hay herramientas que permiten la representación de una iluminación global que, si bien no cuentan con el poder suficiente para gestionar todo tipo de rebotes y reacciones lumínicas en tiempo real, se las apañan para emular de forma eficiente la reacción realista de los entornos ante diferentes fuentes de luz dinámicas. A grandes rasgos, la Radiosidad es un algoritmo mediante el cual se representa una escena cuya iluminación tiene en cuenta los diferentes grados de difusión lumínica de los objetos representados, por lo que, además de generar sombras con mayor o menor grado de definición, interpreta todos los rebotes de luz y los representa en la escena de forma realista. Pese a todo, los sistemas habituales de Radiosidad tienen inconvenientes, causa por la cual la utilización de diferentes algoritmos de iluminación global (como el denominado Mapeado de Fotones, desarrollado por Henrik Wann Jensen) se hace necesaria para conseguir el realismo alcanzado en algunas producciones animadas.

Para conseguir un entorno interactivo iluminado de forma realista, videojuegos como Crysis Warhead, Gears of War 2 o Killzone 2 utilizan técnicas de iluminación global y efectos especiales de simulación lumínica para la presentación de su apartado visual. El High Dynamic Range (Renderizado de alto rango dinámico o HDR), utilizado en videojuegos como Fallout 3, permite la representación de entornos donde las diferentes intensidades lumínicas cubren un inmenso rango de valores. De esta forma, la luz cegadora del sol , al observar elementos a contraluz, infecta dichos elementos pero no los diluye en la oscuridad (como sucede a través de una cámara fotográfica), interpretando una misma escena de forma realista, aunque en ella se entremezclen zonas con una diferencia lumínica considerable. De este modo, el HDR intenta imitar la visión de la realidad a través del ojo humano, cuya pupila se adapta a las distintas intensidades luminosas de un mismo lugar, para enviar al cerebro una interpretación visual donde se distingan con claridad todos los elementos del entorno.

Por su parte el SSAO (Screen Space Ambient Occlusion) es una técnica que intenta aproximarse a los efectos de oclusión de ambiente utilizados para renderizar escenas generadas por ordenador. Por ejemplo, se aprovecha para representar la tenue iluminación que recibe un espacio, donde la luz solo llega a través de pequeños agujeros o grietas. Asimismo, se encarga de que ciertas zonas escondidas ante la acción directa de uno o varios focos, se muestren en penumbra (el interior de la boca de un personaje, a plena luz del día, no debe percibirse nunca en total oscuridad mientras habla, pues los efectos de una iluminación global generan multitud de rebotes que pueden alcanzar zonas que no están expuestas, de forma directa, a los focos de luz principales). Su aplicación ha generado resultados bastante satisfactorios y realistas en títulos como S.T.A.L.K.E.R. o Gears of War 2.

La proyección de sombras dinámicas en tiempo real, es otra de las características que elevan el realismo de cualquier espacio escénico vectorial, concebido bajo el punto de vista de la representación objetiva. Motores como Beast, de Illuminate Labs, intentan que la representación de sombras cuya suavidad, opacidad y definición en sus bordes varía en función del contexto lumínico, pueda ser adaptada fácilmente en motores gráficos como Unreal Engine 3 o Gamebryo. Aunque los resultados vistos en consolas suelen ir acompañados de bugs, parpadeos y bordes tramados (sobretodo cuando hablamos de self-shadowing), los resultados obtenidos en títulos como Killzone 2 son más que satisfactorios. Estos problemas se ven superados, en su mayoría, al disfrutar de videojuegos de última generación como Crysis Warhead en un potente ordenador personal. Por otra parte, los efectos de iluminación dinámica con proyección de sombras en tiempo real, es uno de los aspectos más importantes para la representación del ciclo Día-Noche en títulos como Fable 2 o Grand Theft Auto 4.

Efectos gráficos complejos como la simulación de la profundidad de campo, el desenfoque de movimiento aplicado a elementos concretos de personajes y decorados, así como la representación de los rayos del sol atravesando superficies orgánicas como árboles o vegetación y la representación de nubes volumétricas, son los responsables del realismo visual que podemos disfrutar con títulos como Killzone 2, Ace Combat 6, Resident Evil 5 o Mirror's Edge. La tremenda complejidad de videojuegos como Gears of War 2, que gestionan multitud de texturas y elementos geométricos por segundo, potenciados por efectos de iluminación y post-procesado complejos, hace que mostrar todo esto en tiempo real a 30fps sea un logro encomiable. La inclusión de un efecto de desenfoque de movimiento a la escena cuando hay desplazamientos rápidos de cámara, se traduce en una ilusión de suavidad mayor, aumentando también la sensación de realismo.

En otro orden de cosas, cuando observamos elementos de la realidad que se desplazan a una velocidad elevada, no percibimos con total exactitud sus características formales. Del mismo modo, al capturar escenas con una cámara de video, los momentos de mayor dinamismo generarán imágenes que, al pausarlas, mostrarán un difuminado direccional característico en los elementos que se desplazan de forma violenta. El traslado de este efecto al entorno interactivo, lo encontramos en el desenfoque direccional aplicado a elementos aislados del entorno en títulos como Resident Evil 5. De esta forma, los enemigos alados que emergen de los infectados en este título, ven potenciada su acertadísima animación de vuelo con un desenfoque de movimiento aplicado en sus alas, de orientación radial. La sensación de realidad se ve aumentada exponencialmente gracias a la inclusión de dicho efecto. Con un objetivo similar, la simulación de la profundidad de campo en el espacio escénico interactivo se inspira en la fotografía, generando zonas de interés que muestran una definición clara, combinadas con otras cuyo desenfoque potencia la sensación de profundidad en entornos complejos. Mientras más profundidad de campo haya, mayor será el rango del espacio representado con nitidez.

Para que el apartado gráfico de un videojuego se muestre en pantalla de forma eficaz, una serie de filtros gráficos se encargan de evitar problemas habituales en la representación de entornos interactivos tridimensionales. Para evitar los temidos dientes de sierra, los problemas generados por la representación del texturizado tridimensional, los fallos en la transición entre mapas de repetición y las incongruencias provocadas por la utilización de Mipmapping , se recurre habitualmente al Antialiasing y a los filtros Trilinear y Anisotrópico, con la única finalidad de conseguir una sensación más real del espacio interactivo tridimensional, representado en tiempo real.

RECREACIÓN SONORA DEL ENTORNO JUGABLE

Aunque este apartado es uno de los que menos se tienen en cuenta a la hora de alabar las virtudes técnicas de un videojuego, es imperante resaltar la importancia de los efectos sonoros en la recreación de un espacio escénico interactivo realista.

Desde la inclusión del CD en el mundo de los videojuegos, las posibilidades de adaptación de un entorno sonoro de alta fidelidad, digitalizado desde la realidad, dieron muy buenos resultados. Los sonidos sintetizados, de todos modos, han seguido presentes en el mundo de los videojuegos. Sin embargo, títulos de pretensiones realistas como los pertenecientes a las sagas Call of Duty, optan por la elaboración de una librería rica en elementos grabados directamente de la realidad. El éxito de un sistema sonoro, radica en la adecuación del mismo dentro del contexto interactivo, de forma que cada acción representada en la escena tenga una reacción acústica coherente. Por ejemplo, para la recreación de una superficie marina tendremos que idear una librería específica, con diferentes sonidos para las olas, las salpicaduras y los impactos del agua sobre distintos elementos. Los pasos de los personajes se pueden representar con varios sonidos para el impacto de la suela en diferentes superficies. Es importante editar variaciones del mismo efecto, para que la monotonía sonora no se apodere del jugador cuando, por ejemplo, avanza durante un tiempo considerable sobre una superficie asfaltada.

El ambiente acústico de un videojuego también tiene gran importancia para la representación de un espacio escénico realista. Sin llegar a saturar de forma excesiva al jugador, videojuegos como Dead Space potencian el realismo de sus entornos con una respuesta sonora de gran calidad ambiental, que se adapta a las diferentes situaciones que brinda cada título. La repetición de un sonido en bucle, la variación sonora de un espacio dependiendo de la situación del jugador, la prioridad de un efecto sobre otro en determinadas ocasiones o la duración y velocidad de una pista acústica son solo algunos de los aspectos que intervienen en la edición de este importante apartado técnico.Aunque no es un elemento determinante en la búsqueda del realismo en un contexto interactivo, la música se encarga de potenciar el apartado sonoro de un videojuego para enfatizar determinadas situaciones o acompañar al jugador a lo largo de sus incansables viajes, siendo un aliado perfecto en la definición de entornos interactivos con alto grado de inmersión.

REALISMO INTERACTIVO DE NUEVA GENERACIÓN

Después de repasar los pormenores de la representación visual realista en el contexto interactivo, basándonos en una concepción del tema fundamentalmente estática, llega el turno de analizar el dinamismo en videojuegos, descrito principalmente por los sistemas de animación pasivos (utilizados para la representación del movimiento en escenas o situaciones donde no interviene el jugador) e interactivos (fundamentados en las reacciones de los elementos en función del control del jugador). Los avances en los sistemas de captura de movimientos, permiten trasladar las acciones naturales del ser humano al entorno interactivo, encontrando una fiel representación de la biomecánica humana en muchos videojuegos de diferentes géneros. La idoneidad de estas técnicas se pone de manifiesto en títulos como FIFA 09 o NBA 2K9. Por otra parte, el progreso en la representación de metáforas expresivas complejas, permite la interpretación de expresiones faciales realistas, capturadas directamente de un modelo real. Sin embargo, no trataremos aquí estos temas, debido a que ya ofrecimos un análisis exhaustivo en otro de nuestros reportajes.

Los sistemas de animación por captura de movimientos y los desarrollados mediante fotogramas clave, adquieren una importancia evidente a la hora de animar al personaje -o personajes- controlado por el jugador, siendo un pilar fundamental del aspecto interactivo en un videojuego realista. Junto a esto, la animación procedural y los sistemas de física avanzada se encargan de que la experiencia interactiva se presente de forma natural, estableciendo una conexión específica del entorno con el jugador, involucrando las acciones del mismo dentro de un contexto realista. Tomando como supuesto un entorno interactivo de extremo realismo, donde las superficies, los objetos y la iluminación están representados con todo lujo de detalles, una respuesta interactiva coherente servirá para que la sensación de entorno natural no se vea mermada.

Para explicar de forma general los fundamentos de los motores de física y animación avanzada, utilizaremos este entorno imaginario. Supongamos que nos encontramos en el exterior de un acogedor poblado.

Un pequeño río divide dicho poblado, hay varias casas dispuestas a ambos lados del mismo y algunos personajes están arreglando una pequeña embarcación de madera. Varias chicas tienden la ropa al lado de sus respectivas casas, aprovechando el soleado día. Nos disponemos a interactuar con el entorno manejando a nuestro personaje. Empujamos con esfuerzo un pesado barril de madera y sale rodando por la ladera gracias al motor Havok. La inclusión de este motor en el videojuego Half Life 2 permitió la edición de un entorno cuyos objetos reaccionaban en base a las leyes de Newton. Los personajes que se distraen con la embarcación ven como se les abalanza de forma violenta el barril, que rueda con una velocidad descontrolada. Uno de ellos consigue esquivarlo, mientras el otro recibe el brutal impacto. Gracias al motor de animación dinámica Euphoria, nuestro maltrecho personaje sale por los aires mediante físicas Ragdoll, pero intenta agarrarse al puentecito que pasa por encima del río para no caer al agua. Consigue quedarse colgado con una mano, aunque no logra sostenerse durante mucho tiempo, precipitándose irremediablemente al río.

Por medio de este motor patentado por Natural Motion, la animación dinámica de personajes en Grand Theft Auto 4 reflejó un resultado sorprendente, generando situaciones únicas e irrepetibles. Cuando el barril cae al agua, el líquido elemento genera ondulaciones realistas que intervienen sobre la maya poligonal, gracias a un sistema de partículas gestionado por el Octave Engine. Las bondades de este motor de partículas se verán reflejadas en el próximo Tekken, contexto interactivo que, sin embargo, no se rebela como el escenario ideal para el aprovechamiento de este tipo de técnicas procedurales. El barril ve detenido su avance por un violento impacto con la pequeña embarcación que estaba situada cerca del río. La estructura de madera salta en mil pedazos, astillándose y quebrándose según el ángulo y la intensidad del impacto por medio del motor Digital Molecular Matter. Las bondades de este revolucionario sistema de roturas y deformaciones en tiempo real, puede verse en la recreación de superficies dinámicas para el videojuego Star Wars: The Force Unleashed. Las chicas que tendían la ropa acuden al lugar del incidente, descuidando una sábana que sale volando por la acción del viento. La gestión compleja de la física de tejidos demanda la actuación del PhysX, chip dedicado a la gestión de operaciones físicas complejas. Por medio de este chip, incluido en algunas tarjetas gráficas de nueva generación, se añadieron elementos con dinámicas realistas en la versión de Mirror's Edge para PC.

Como podemos comprobar, si uniéramos las posibilidades que brindan las técnicas de animación procedural en un mismo videojuego, el resultado interactivo completaría la dedicada recreación visual de su entorno realista. Posiblemente llegue el día en que la ausencia de dicha interactividad global se haga menos habitual, gracias a los avances gráficos en los sistemas de entretenimiento interactivo.

La inmersión del jugador en un espacio interactivo que evoluciona ante sus acciones, necesita de una respuesta coherente por parte de los PNJs (personajes no jugables) y enemigos que completan el contexto escénico de muchos videojuegos, para dar lugar a un conjunto creíble. Para ello, la correcta configuración de un sistema de Inteligencia Artificial bien diseñado, se hace imprescindible dentro de una experiencia virtual realista. En muchas de las publicaciones impresas y artículos de investigación sobre materia de IA, así como en los congresos y convenciones proyectados sobre esta temática, surge siempre el nombre de una famosa saga de videojuegos: Halo. Desde la presentación del sistema de inteligencia artificial gestionado bajo Árboles de Comportamiento que se utilizaría en Halo 2, esta técnica ha sido adaptada a muchos videojuegos. En la ponencia que Ricard Pillosiu (Crytec) brindó a los asistentes del CDV 2008, se expusieron los fundamentos de esta técnica y su adecuación para gestionar tácticas de grupo. De forma general, la coordinación de IAs mediante Árboles de Comportamiento, fundamenta su programación en el diseño de complejos esquemas, donde se tienen en cuenta variados factores que intervienen en las reacciones que pueden interpretar los personajes.

De esta forma, el comportamiento de un enemigo será diferente si es atacado de frente, por uno de sus flancos, si tiene munición o no, si le quedan granadas, si tiene acceso al apoyo de sus compañeros, etc., pudiendo mostrar mayor o menor agresividad en base a su estado de ánimo. En caso de no tener munición, puede optar por utilizar una granada, buscarla en un arsenal cercano o llamar a un compañero. Si encuentra munición la utilizará, si no la obtiene y no le quedan granadas, se cubrirá para pedir ayuda, ante lo cual puede obtenerla y conseguir munición del compañero, o verse obligado a huir al no recibir el socorro de su escuadrón. Todas estas posibilidades se contemplan en su árbol de comportamiento personal, cuyos engranajes, perfectamente sincronizados en diferentes ramas, configuran su sistema de Inteligencia Artificial particular.

La ausencia de sistemas de Inteligencia Artificial, a favor de la configuración de contextos escénicos realistas donde cada personaje es controlado por un jugador diferente en cualquier parte del mundo, configuran los fundamentos de las comunidades online que giran en torno a simuladores sociales como Second Life o Home. Asimismo, la producción de videojuegos masivos online (MMOG) se proyecta en la concepción de variados espacios escénicos donde millones de jugadores cooperan o compiten juegos de diferentes géneros, para definir experiencias dinámicas que evolucionan a través de Internet, como las que se han desarrollado durante años alrededor del MMORPG (Juego de rol multijugador online) World Of Warcraft.

Más allá de los motores de física y animación avanzados, el realismo en videojuegos se basa también en aspectos referentes a la capacidad interactiva del jugador y su grado de decisión dentro de un entorno virtual. Llegados a este punto, es importante recalcar una cuestión. Los títulos que brindan al jugador un alto grado de libertad de acción y decisión, son tan importantes como aquellos que proporcionan pequeños detalles interactivos, fundamentados en la representación de momentos únicos y sorprendentes, que potencian de forma notoria la inmersión en el entorno. Para aclarar este razonamiento, recurriremos a dos rápidos ejemplos. Títulos como Fallout 3, ponen a nuestro alcance mundos de una compleja inmensidad, que podemos recorrer hasta donde nos alcance la vista, descubriendo nuevos territorios que alimentan nuestro instinto exploratorio. Estos lugares ofrecen distintos contextos interactivos, que pueden resolverse por medio de variadas estrategias, en función de nuestras decisiones. Por otra parte, el realismo interactivo no requiere de una representación objetiva del espacio jugable.

The Legend of Zelda: The Wind Waker, cuenta con un aparatado artístico alejado del realismo formal de Twilight Princess, pero ofrece algunas experiencias que representan de forma efectiva la idea que exponíamos anteriormente; la de ofrecer momentos cuya coherencia con la realidad es la base de su éxito, aunque se muestre en forma de pequeños detalles. Si durante nuestra aventura, examinamos las posibilidades de su contexto jugable, se nos puede ocurrir dar caza a uno de los cerditos que pululan por determinados emplazamientos. Nos agazapamos y, cuando está desprevenido, lo cogemos con decisión para evitar que escape. No es extraño que se nos ocurra realizar una pillería, del tipo 'lanzar el cerdito al mar a ver que pasa'. Cuando en otros títulos, una barrera impediría que el personaje alcanzara el líquido elemento, otros posiblemente no habrían tenido en cuenta la posibilidad de que al jugador se le ocurriera realizar esta hazaña, y el cerdo desaparecerían entre las olas vectoriales. Sin embargo, en Wind Waker el cerdito impacta con el agua, salpica, comienza a nadar hasta llegar a la orilla y, cuando está en tierra firme, se sacude con un gracioso movimiento. Este ejemplo pone de manifiesto como el cuidado de los programadores por ofrecer una experiencia atractiva para el jugador, se traduce en un incremento del realismo en el entorno interactivo gracias a estos pequeños detalles.

Por otra parte, la utilización de periféricos externos para potenciar la experiencia de simuladores de conducción (RFactor, GTR) o aviación (saga Flight Simulator) en forma de volantes con Force Feedback y Joysticks especiales, contribuyen a mejorar el realismo en este tipo de producciones. En otro orden de cosas, la jugabilidad que proporcionan algunos títulos de la consola Wii, se fundamentan en un control basado en el traslado de las acciones físicas del jugador al entorno interactivo. Sin duda, la inmersión que proporciona este sistema en videojuegos como Metroid Prime 3 Corruption es más que evidente, ayudando de manera eficaz a que la interacción del jugador con el entorno responda de manera bastante fiel a sus movimientos, tanto a la hora de apuntar como al manejar determinados mecanismos.

Otros títulos, sin embargo, pierden realismo al comprobar que no es necesario interpretar el movimiento como lo hacemos en la realidad, para que el efecto sea eficiente. Con una leve agitación conseguimos mayor éxito que con una exagerada acción, como podemos intuir tras varias partidas con Wii Sports. Mediante la adaptación del periférico Wii MotionPlus al Wiimote, la experiencia interactiva promete ganar en profundidad jugable, permitiendo una representación mucho más fiel de las acciones del jugador en el entorno interactivo. Si todo lo que prometen las demostraciones realizadas sobre los videojuegos Grand Slam Tennis y Red Steel 2 se traducen en una experiencia interactiva profunda y de sorprendente exactitud, el realismo gráfico y jugable en videojuegos tridimensionales puede verse potenciada por una respuesta dinámica del jugador perpetrada por sus propias acciones. Y es que todos los aspectos que hemos comentado en este artículo y su evolución en los próximos años, definirán tendencias futuras para la representación del realismo en videojuegos.