Radeon 2

Grandes promesas

Radeon 2: El chip R200

ATI lo tiene ya todo listo para lanzar al mercado su chip Radeon 2 y luchar así contra la GeForce 3 en el segmento alto de tarjetas gráficas para jugadores. La compatibilidad total con DirectX8 era una de las prioridades al crear el chip, pero no contentos con esto, los ingenieros de ATI han creado dos nuevas tecnologías para mejorar aún más los gráficos de los futuros juegos: Truform y Smartshaders, de las que hablaremos aquí largo y tendido.

Pero lo primero es hablar del chip: el R200 está fabricado con tecnología de 0.15 micras, lleva cuatro motores de rendering (aunque se rumorea que incluso seis) con seis texturas por motor y corre a 250 MHz. Soporta DX8.1 (Vertex y Píxel Shaders), AGP 4X y tecnología Hydravision para manejar dos dispositivos de pantalla. Este será el primer modelo de Radeon 2 que aparezca en el mercado, pero ya hay planes para lanzar una versión MAXX (con dos chips en paralelo) y una versión Pro, con el chip a 400 MHz. De la memoria todavía no se sabe nada, pero va a tener que ser muy rápida para poder hacer todo lo que nos prometen.

También está previsto sacar un chip RV200, pero poco tiene que ver con Radeon 2. Al contrario de lo que su nombre parece indicar, este chip no es un Radeon 200 VE, sino que es un Radeon con algunas mejoras como que está fabricado con tecnología de 0.15 micras y que permite que la memoria y el chip lleven velocidades de reloj diferentes. Esta última característica no está presente en las Radeon, cuyo controlador de memoria sólo permite que la velocidad del chip y de la RAM esté sincronizada. Por otro lado, el RV200 no soportará Vertes y Píxel Shaders.

Una vez que hemos visto las características del R200, es el momento de hablar de las dos novedosas tecnologías que incorpora: Truform y Smartshader...

Truform:

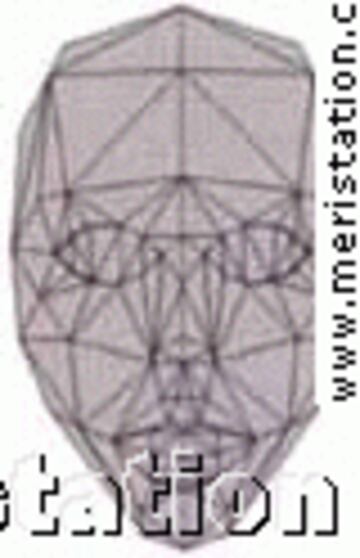

Como todos los aficionados a los juegos 3D sabréis, los escenarios y personajes que aparecen en estos juegos están compuestos de polígonos, concretamente de triángulos. Así, para representar un cuadrado se usan dos triángulos y para representar una cabeza se disponen como en esta foto:

Es obvio que cuantos más triángulos, mejor aspecto tendrá el resultado final, pero también necesitaremos mayor potencia de procesado del chip gráfico, mayor ancho de banda de la memoria y mayor cantidad de ésta, porque necesitamos transferir y almacenar más información. Por ello, cuando los diseñadores gráficos de un juego crean sus modelos 3D, no sólo deben llegar a una solución de compromiso entre número de polígonos y realismo, sino que además deben tener en cuenta qué habrá en ese momento en pantalla. Si el escenario consta de una sala rectangular con un solo enemigo, éste podrá tener muchísimos polígonos, pero en escenarios con muchos enemigos y decorados con superficies menos regulares, habrá que reducir drásticamente el número de polígonos de los personajes.

Por suerte, varias tecnologías han permitido eludir en parte estas limitaciones. Una es el bump mapping o mapeado de rugosidad, que permite el crear superficies con relieve sin aumentar el número de polígonos (juegos como Expendable o Giants lo demuestran). Otra es el nivel de detalle dinámico, que hace que el número de polígonos y la resolución de las texturas de un objeto disminuya al alejarse la cámara de él (como en Black & White, por ejemplo). En el primer caso, no hay problema porque todas las tarjetas gráficas de última generación soportan Bump Mapping en alguna o todas sus formas (Radeon, GF3 y Kyro soportan todas: Dot-3, Emboss y Environmental), pero esto no ayuda para crear superficies más curvas. En el segundo caso, si la transición no es suave, parece que los objetos cambian de forma según nos alejamos de ellos (como las montañas de Black & White).

Es por ello que ATI inventa el Truform, que a grandes rasgos, convierte superficies poligonales en curvas gracias a la unidad T&L del chip R200.

La representación de superficies curvas no es posible en una tarjeta gráfica actual: no se pueden crear modelos con curvas (como los personajes de Toy Story o Final Fantasy) en tiempo real porque ni los juegos ni los chips están preparados para ello y además, un chip que genere polígonos no puede generar curvas y viceversa. Entonces, ¿cómo lo hace el Radeon 2?

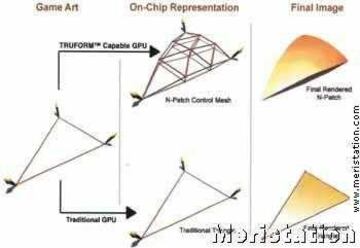

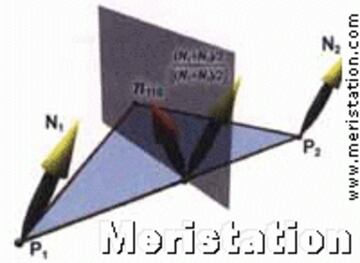

Cuando un triángulo llega al chip para ser renderizado, en realidad llegan seis datos: los tres vértices del triángulo y las tres normales de estos vértices. Así, el chip sabe como unir los vértices y sabe cómo sombrearlo e iluminarlo. Esto sería el método clásico. Pero en el caso del R200, cuando el triángulo llega al chip, éste crea N-Patches para formar un objeto N-Patch: una superficie curva descrita por la información de un triángulo plano. Funcionan mediante dos puntos de control, uno en cada cara del triángulo, y que sirven para la formación de seis nuevos vértices. Estos puntos de control son creados en un plano separado que puede estar situado sobre o bajo el triángulo original y su localización se determina mediante la información contenida en los vértices de este triángulo, como muestra la siguiente figura:

/es/node/Array

Como la normal de un vértice nos dice cómo se reflejaría la luz en él, se puede tomar esta normal como una cualidad de la superficie: el modo en el que la luz rebota en ella, describe su forma y la curvatura. Una vez que el polígono está totalmente recubierto por la forma N-Patch, se crea una superficie curva compuesta por triángulos planos, ocho en total, que ahora tienen representación no sólo en los ejes X e Y, sino también en el Z.

Como todo esto ocurre en el motor T&L capaz de manejar Truform, no se pierde rendimiento en la creación de estas nuevas superficies.

Una vez que se ha creado la superficie curva hay que volver a pasarla a triángulos para que la tarjeta pueda mostrarla. Para ello, la superficie creada se divide en pequeños triángulos, en un proceso llamado teselación (los aficionados a 3D Studio reconocerán este término). Cuanto mayor sea el grado de teselación, más triángulos se crearán y el resultado final será más próximo a una superficie curva.

Como todo este proceso vuelve a realizarse en el chip R200, tampoco ahora perdemos rendimiento. Y tampoco se necesita volver a pasar la información de las texturas al bus de memoria, porque estas texturas siguen siendo las mismas.

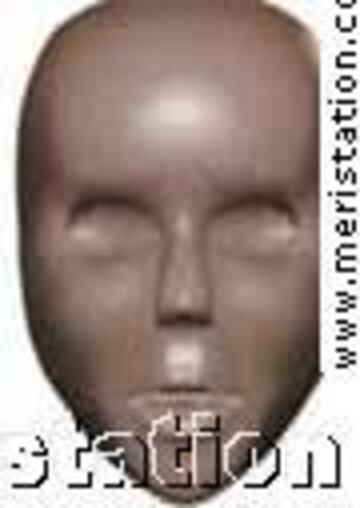

Veamos una comparativa del proceso tradicional y de Truform:

El resultado es que conseguimos una forma mucho más realista sin aumentar el número de triángulos: no ha pérdidas de rendimiento ni necesitamos más memoria y mayor ancho de banda.

Falta saber cómo iluminamos ahora esta superficie curva, porque la información que teníamos para las normales de los vértices del triángulo plano ya no nos sirve. Para ello, se crean nuevas normales en el centro de cada lado de la forma N-Patch. Esto se hace hallando la media de las normales de los vértices en ambos extremos de una cara y luego reflejando esta normal promedio a través de un plano perpendicular a ese lado. Ahora mismo debes estar con una cara de no enterarte de nada alucinante, pero vamos a ver si se ve mejor con un dibujo:

Coges las normales N1 y N2 y hallas la media (la flecha esa que hay en el centro del segmento P1-P2. Dibujas el plano perpendicular y hallas la otra flecha, reflejo de la normal promedio a través de ese plano. ¿Mejor ahora? De nada... ;-)

Gracias a esta nueva normal, ahora tenemos normales no para los vértices, sino para cada triángulo que compone la superficie curva, consiguiendo con ello una iluminación mucho mejor y un aspecto más realista. No hay más que ver la siguiente imagen, para ver cómo queda renderizada la cara del principio del artículo mediante la técnica convencional (izquierda) y mediante Truform (derecha).

Pero, ¿esto es propio de ATI o es estándar de las DirectX o qué? Pues no es más que una implementación de las N-Patch que está incluido en las DirectX8 y en OpenGL. Para que un juego aproveche esta tecnología, basta incluir una única línea de código, por lo que incluso los juegos antiguos podrían usarla sin más que aplicar un sencillo parche. Como los triángulos y texturas son los mismos, no hay que crear nuevos modelos 3D, todo lo hace la unida T&L del R200. Lo ideal sería que parámetros como aplicar Truform o no o el grado de teelación, fuesen controlados por el jugador desde los drivers del chip, pero parece ser que si se aplica el Truform a toda una escena, se podrían dar errores visuales al eliminar ángulos rectos. Pero ATI parece que ya tiene solucionado esto, haciendo que esta revolucionaria tecnología no se aplique cuando dos normales forman un ángulo de 90º entre sí, ya que este ángulo no debe ser suavizado.

Si todo es tan bonito como nos lo han puesto, ATI debería sacar parches para todos los juegos habidos y por haber. Títulos donde los objetos tengan gran cantidad de curvas (como los coches de Need for Speed, o las naves de Starlancer o las armas de Quake 3 o Unreal Tournament) se beneficiarían enormemente de este hallazgo. Sólo tenemos una duda: la imagen de la cara renderizada con Truform queda mucho más suave, pero el reflejo de la iluminación queda más artificial, más como si la cara fuera de plástico.

¿Todos los objetos renderizados con Truform van a quedar así? No, no os preocupéis, porque esa cara es sólo para ver cómo se iluminan las superficies curvas. La iluminación de cada triángulo viene dada por la media de las normales de los vértices y por tanto, la figura reflejará la misma luz que el triángulo original. Brillos y sombras van a ser similares, pero con mucho más detalle cuando se usa el Truform, como se puede ver en esta imagen de CounterStrike.

La imagen de la derecha, la del modelo renderizado mediante Truform muestra claramente la mejoría obtenida, sobre todo en la forma del casco, mucho más suave. Si todos los juegos mejoran tanto, ATI no va a fabricar suficientes tarjetas para satisfacer la demanda.

Smartshader:

Los Vertex y Píxel Shaders incluidos en DirectX8 están de moda. Los gráficos que usan estas características dejan a años luz a todo lo visto en cuanto a calidad, no hay más que ver las imágenes del test Nature de 3Dmark 2001, sólo visible en la actualidad en una GeForce 3. Como es lógico, cada marca sacará nuevas tarjetas que sean compatibles con estas nuevas tecnologías, pero ATI no se ha limitado a hacer esto, sino que ha ido un paso más allá y su chip R200 incorporará nuevos Shaders que gracias a su acuerdo con Microsoft, estarán incluidos en DirectX8.1.

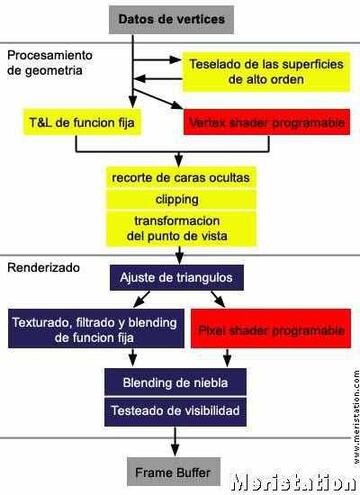

Recordemos que los Píxel y Vertex Shaders permiten a los diseñadores gráficos implementar sus propias subrutinas para el tratamiento de vértices, consiguiendo efectos muy sofisticados. Aquí podéis ver dónde se usan los Shaders, con lo que se pueden aplicar otros efectos diferentes de los prefijados.

ATI ha creado nuevas instrucciones y registros que Microsoft ha añadido a DX8.1 y más es mejor, ya que todas las cosas que hasta ahora se hacían en el hardware particular de la tarjeta (como el Motion Blur de las 3dfx, por ejemplo), ahora se hacen programándolo mediante los Shaders. Por tanto, ya no hará falta crear instrucciones específicas para una tarjeta apropiada o que los programadores tengan que hacer gráficos diferentes para cada chip, sino que simplemente metiendo los nuevos registros e instrucciones en las DirectX, se consigue una total compatibilidad con cada GPU que salga.

El SmartShader de ATI incluye los Píxel Shaders v.1.4. ¿Qué caracteriza a cada versión? Pues eso se ve claramente gracias a esta tabla:

| Pixel Shader v1.1 | Pixel Shader v1.4 | |

| Máximo número de entradas de texturas | 4 | 6 |

| Máxima longitud de programa | 12 instrucciones (hasta 4 de muestras de texturas, 8 de mezcla de colores) | 22 instrucciones (hasta 6 de muestras de texturas, 8 de direccionamiento de texturas, 8 de mezcla de colores) |

| Conjunto de instrucciones | 13 operaciones de direccionamiento 8 operaciones con color | 12 operaciones de direccionamiento / operaciones con color |

| Modos de direccionamiento de texturas | 40 | Virtualmente infinito |

DirectX8 introdujo los ps 1.1, mientras que DX8.1 incluye los ps 1.2/1.3 y 1.4. Según Microsoft y NVIDIA, para que una tarjeta sea compatible con DX8.1, basta con que soporte los Píxel Shaders v.1.3, cosa que sí que hace la GeForce3. Pese a que las diferencias entre los ps 1.1 y 1.4 están claras, no se saben muy bien las que hay entre los 1.3 y 1.4. Pero parece que NVIDIA hará todo lo posible para que ATI no le quite mercado a sus GeForce3 por una cuestión de píxel shaders.

En cualquier caso, es bueno que cada vez salgan nuevos píxel shaders, porque así se podrán crear mejores efectos, como sombreado Phong (mucho más realista que el Gouraud), iluminación anisótropa (dependiente del ángulo de incidencia sobre la superficie), Bump Mapping avanzado (pudiendo combinar varios mapas de rugosidad y hacer que estas rugosidades arrojen sombras), o texturas procedurales (implementadas sólo mediante operaciones matemáticas, sin gráficos), todos posibles mediante DX8.1 y ps 1.4. Eso sí, NVIDIA se ha apresurado a declarar que todos estos efectos ya los han usado en la demo de Zoltar para GeForce3 y que decir que sólo el R200 es capaz de hacerlos es incorrecto.

Microsoft también ha hecho que incluir todos estos efectos sea más sencillo y rápido de aprender en la versión 1.4 de los píxel shaders, en un paso adelante para que los diseñadores los aprovechen cuanto antes.

En cualquier caso, SmartShader es la implementación de ATI de los Vertex y Píxel Shaders, como el nFinite FX lo es de NVIDIA. Así que es muy posible que tanto el R200 como el GF3 nos ofrezcan el mismo nivel de calidad en los gráficos de los juegos futuros.

Nueva nomenclatura.

Las nuevas tarjetas de ATi vienen presentadas bajo la que será la nueva nomenclatura utilizada por este fabricante. Aunque se sigue manteniendo la denominación del chip Radeon y los nombres para definir las familias FIRE y All-in-Wonder, se ha optado por añadir un número a continuación de estos nombres. Así nos encontraremos nombres seguidos de un número de cuatro cifras donde la primera marca el tipo de chip que lleva la tarjeta y las siguientes marcan la potencia de esa tarjeta concreta dentro de las tarjetas que llevan ese mismo chip. Así se nos presentan las Radeon 7500 y las Radeon 8500. Las 7500 y todas las Radeon del futuro que empiecen por 7 estarán basadas en el chip RV200. Del mismo modo, todas las tarjetas que empiecen por 8 estarán basadas en el R200 o Radeon II. El hecho de que las dos acaben en 500 facilita que vayan apareciendo sucesivas configuraciones de tarjetas en las que únicamente variarían las frecuencias, memoria u otros elementos como salidas de TV, DV-I... pero nunca el chip gráfico que montan. Es exactamente lo mismo que hace NVIDIA con su actual división de las tarjetas en MX, GTS, PRO y Ultra pero de una forma más sencilla. Pongamos que para navidades ATi lanza una versión económica de su 8500 y otra más rápida... Según la nueva nomenclatura la económica podría llamarse Radeon 8300 y la superior Radeon 8700. Sin duda esta manera de denominar a cada producto pone las cosas mucho más fáciles a la hora de saber dónde ubicar cada tarjeta gráfica respecto a su potencia sólo con ver el nombre.

Marcando diferencias.

Recordemos hace poco más de un año el avance que el GeForce II de NVIDIA supuso sobre el resto de chips gráficos existentes en aquel momento y cómo pocos meses después ATi presentaba su primer Radeon. Un chip que nada tenía que ver con sus anteriores chips Rage y que no sólo soportaba todas las funciones que innovaba el GeForce II, sino que además incluía nuevas funciones que aquel no tenía. Incluso los rendimientos de aquel Radeon superaban a los del GeForce II, especialmente en 32 bit de color y altas resoluciones. Finalmente las posteriores versiones PRO y Ultra del GeForce II acabaron por dejar claro que quienes mandaban en rendimientos seguían siendo los chicos de NVIDIA.

Hoy día volvemos a estar en la misma situación. NVIDIA dio un gran salto adelante marcando enormes diferencias entre sus tarjetas de nueva generación, las GeForce III, y todas las demás. El soporte completo de los DirectX 8.1, haciendo especial hincapié en los Shaders, propiciaban que las GeForce III, aunque no destacasen especialmente en rendimientos, no pudiesen ser comparadas con ningún otro chip del momento... hasta ahora. El Radeon II sí que pertenece a esta nueva generación de chips y no sólo soporta todas las funciones de los DirectX 8, sino que además incluye algunas innovaciones que, de encontrar el suficiente apoyo entre programadores, ensambladores y usuarios, puede poner en serios aprietos al GeForce III. Desde luego capacidad para dejar atrás al hasta ahora intratable GeForce III no le falta, ya que cuenta con unas mayores frecuencias de funcionamiento, una comunicación con la memoria más rápida y, en general, un hardware notablemente mejor que el del chip de NVIDIA.

En cualquier caso, el presente y futuro a medio plazo del hardware gráfico se limita a estos dos chips gráficos; GeForce III y Radeon II, e independientemente de cuál de los dos se lleva el gato al agua, la llegada de los nuevos Radeon no hace más que generar buenas noticias para los usuarios. Partiendo de una mayor oferta entre la que elegir, siguiendo con una mayor competencia y la correspondiente bajada de precios y acabando con el asentamiento de la nueva generación de hardware gráfico por la que los programadores ya pueden apostar sin temor a equivocarse, la nueva familia ATi nos pone de enhorabuena.

ATi Radeon 8500.

La 'GeForce III killer' ATi. Basada en el R200 y 64 Mb de memoria DDR de tan sólo 3.6 nanos, la tarjeta ha sido especialmente diseñada para ofrecer las máximas prestaciones en los juegos del futuro más cercano (Direct X 8). Recordemos que el R200 o Radeon II es un chip fabricado con tecnología de 0.15 micras que funciona originalmente a 250 MHz. Como dato representativo decir que el R200 consta de unos 60 millones de transistores, tres millones más que el GeForce III y a gran distancia de micros como los Pentium o Tbird. El R200 cuenta con dos únicos procesadores de texturas capaces de aplicar hasta seis texturas por pasada.

Esta quizá sea la característica más curiosa de este chip ya que el primer Radeon contaba con tres procesadores de texturas. La razón de este cambio se debe sin duda a que la primera configuración de tres procesadores no ha sido apoyada por prácticamente ningún programador y actualmente es algo de lo que no se puede sacar partido. Y ya puestos a comparar este chip con el anterior Radeon, una de las mayores diferencias la observamos en la tasa de relleno, donde el nuevo Radeon dobla la potencia de su antecesor. El R200 es capaz de rellenar hasta 2 Gigatexels por segundo, frente al Gigatexel largo del primer Radeon. Sin embargo hay que poner los pies en el suelo y admitir que estas tasas son estrictamente teóricas y que los cuellos de botella que forman las memorias las hacen imposibles. Habrá que recurrir a los test para ver cual es la diferencia real entre ambos chips.

Pero mientras no podamos probar una 8500 definitiva con controladores bien pulidos y en unos test Dx8 realmente efectivos y comparar rendimientos con los de una GeForce III, debemos tener claro que, al menos en teoría, el hardware de una Radeon 8500 es sensiblemente más potente que el de una GeForce III. Si a ese mejor hardware se le saca todo el rendimiento posible, quizá sí que estemos ante esa 'GeForce III killer'.

En cuanto a precio y disponibilidad, todo apunta a que podrán empezar a encontrarse unidades a la venta a finales de este mes de Septiembre. El precio, éste en principio partirá en los 399 dólares aunque seguramente sufrirá alguna variación. Serán variaciones presumiblemente a la baja, pero dado el complicado momento económico que se vive en estas fechas, es difícil apostar por ello.

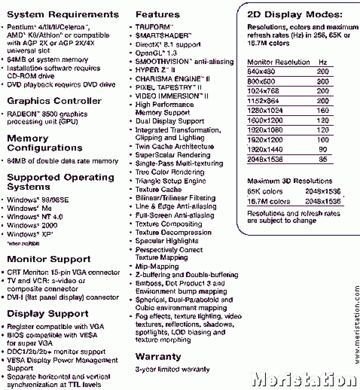

A continuación os mostramos un "scan" de la parte trasera de la caja de la 8500 con el fin de mostrar el interminable listado de funciones disponibles...

ATi Radeon 7500.

El chip RV200 en el que se basan las 7500, al estar destinado al segmento medio del mercado, podría hacernos pensar en una versión con una menor velocidad de reloj y memoria que las 8500 pero que mantuviese las demás características del chip R200... pero no es así. El RV200 cuenta con importantes diferencias respecto al R200. Los más aficionados al hardware habrán oído hablar repetidamente durante este año de las Radeon SE... Estas tarjetas serían un paso intermedio entre el primer Radeon y el Radeon II que ahora se presenta y serían el equivalente a lo que fueron las GeForce II Ultra respecto a las GeForce II GTS, es decir, el mismo chip pero funcionando a mayores velocidades. Finalmente las Radeon SE no llegaron a comercializarse como tales y es ahora cuando finalmente llegan al usuario bajo el nombre de Radeon 7500. Por esta razón, es mucho más acertado comparar las Radeon 7500 con las primeras Radeon que con las Radeon 8500 y su R200 o Radeon II. A falta de profundizar un poco más en las especificaciones y entrar en los test, el RV200 es idéntico a un Radeon original salvo por la tecnología de 0.15 micras con la que está fabricado frente a las 0.18 del primero. Esta diferencia en la fabricación permite que el RV200 pueda funcionar a velocidades notablemente mayores que el Radeon. Exactamente el RV200 funciona con el reloj a 270 MHz y la memoria a 230 MHz, frente a los 183 MHz que soportaba el Radeon tanto para reloj como memoria.

ATi centra las mayores diferencias entre Radeon y Radeon 7500 en que el nuevo chip disfruta de un mayor acceso a memoria, 256 bit frente a los 128 del antiguo. Esto nos hace pensar que aunque el chip no tenga en sí nada que ver con el nuevo R200, sí que usa el mismo control de acceso a memoria que éste. Por otro lado el RV200 aprovecha otras innovaciones que ATi ha desarrollado con posterioridad a la presentación de su primer Radeon. Estas innovaciones las habríamos conocido con las Radeon VE, unas tarjetas destinadas principalmente al aprovechamiento de dos monitores y que introducía en el mercado con gran acierto la herramienta Hydravision. En resumidas cuentas podríamos decir que el RV200, y por extensión las Radeon 7500, son una especie de cruce entre Radeon, Radeon VE y Radeon II. Habrá que esperar a probarla a fondo, pero desde ya podemos apostar más acertadamente por las Radeon 8500, que son el hardware que realmente innova y proporciona todas las funciones y rendimientos que ATi puede ofrecer.

La disponibilidad de estas tarjetas será anterior a la de las 8500, así que en cuestión de días podríamos empezar a buscarlas. El precio de partida serán 179 dólares, aunque hemos de insistir en lo comentado sobre este aspecto en la página de las 8500...

Radeon II contra GeForce III.

A falta de poder probar a fondo una Radeon 8500, las diferencias teóricas entre ambos chips resultan notables, existiendo funciones para cada chip que prometen una interesante pugna por hacerse con el mercado. Aunque ambos chips mantienen su base fundamental en las directrices marcadas por Microsoft y sus DirectX 8.1, prestando especial atención a los Vertex y Píxel Shaders, las pequeñas diferencias en su aplicación provocarán las consiguientes diferencias en la reproducción del software que cada programador puede haber optimizado para uno u otro chip.

Por ejemplo, las diferencias en cuanto a rendimientos podrían decantarse hacia las Radeon II gracias a su capacidad de aplicar seis texturas por cada pasada frente a las sólo cuatro que pueden aplicar los GeForce III. De nuevo las determinaciones que tomen los programadores de juegos a la hora de tener en cuenta o no esas seis texturas por pasada vuelven a ser decisivas.

Si bien la mayor potencia del Radeon II a la hora de texturar puede ser determinante, donde presumiblemente se van a apreciar mayores diferencias es en el aprovechamiento de la memoria que hace cada chip. Por un lado tenemos la tecnología Crossbar de NVIDIA y enfrente la tecnología Hyper Z II de ATi. Ambas tecnologías apuestan por lo mismo, liberar el mayor caudal de memoria posible para que la información viaje más deprisa, pero lo hacen de forma muy distinta. De nuevo habrá que esperar muchos meses para ver por fin qué tecnología se acaba mostrando más efectiva.

Otro choque lo veremos alrededor de la tecnología que recientemente las Kyro II volvieron a sacar a la luz, el 'Tile rendering' o rénder por celdas. Esta técnica a la hora de renderizar la escena tiene probada eficacia y es de prever que los futuros chips la aprovechen. Así lo hacen tanto GeForce III como Radeon II, aunque de nuevo lo hacen de forma diferente. Mientras el Radeon II elimina 64 píxeles por ciclo de reloj, las GeForce III sólo eliminan 16 píxeles, pero de un modo mucho más 'llevadero' de modo que los accesos a memoria son más rápidos... con lo que volvemos a quedarnos sin un favorito claro.

Donde sí puede distinguirse un posible ganador es a la hora de aplicar el AntiAliasing a pantalla completa (FSAA). ATi presenta su tecnología Smoothvision frente a la tecnología Quincunx de las GeForce III de NVIDIA. Si bien la calidad de imagen conseguida con ambas tecnologías es muy similar (en el fondo ambas acaban haciendo lo mismo), la tecnología de ATi parece ser más efectiva dado que influye mucho menos en los rendimientos finales. Según los primeros rendimientos ofrecidos por ATi y extraídos de los primeros análisis independientes con una Radeon 8500 beta, por fin el uso del antialiasing no va a impedir una correcta velocidad en el juego.

Por último, el hecho de que las Radeon sean un hardware más reciente las permite incorporar funciones que eran inexistentes cuando se lanzaron las GeForce III. Un ejemplo es el soporte para la versión 1.4 de los píxel shaders frente a la versión 1.3 soportada por el GeForce III. De nuevo este detalle puede importar o no dependiendo de lo que estimen oportuno los programadores a la hora de aprovechar o no las mejoras de esa versión, pero presumiblemente las diferencias entre la versión 1.3 y 1.4 no serán tantas como para ser decisivas.

Por lo demás, el dicho de que 'Las Radeon 8500 hacen todo lo que hacen las GeForce III y algunas cosas más' no deja de ser cierto. Cualquier función del chip de NVIDIA tiene su respuesta en el chip de ATi. Los importantes Vertex y Píxel Shader (N-Patches de los DirectX 8) tienen su equivalencia en el SmartShaders de ATi, siendo incluso más efectivo el tratamiento sobre los píxeles de ATi que el de NVIDIA. Lo mismo ocurre con las 'Higher order surfaces' de NVIDIA y el Truform de ATi, los ya comentados Quincunx y Smoothvision o los controladores de memoria Crossbar e HyperZ...

A primera vista lo que vemos es que los usuarios normales nos vamos a volver un poco locos entre tantos nombrecitos para definir una misma función. Al final, después de comprobar que ambos chips hacen prácticamente lo mismo, sólo nos faltará comparar cuál de los dos lo hace mejor, más rápido y, lo que es más importante,... por menos dinero.

Conclusiones:

Partamos de la idea de que el R200 ó Radeon II es un chip excelente, probablemente lo mejor que hemos podido ver hasta ahora. Sobre el papel se muestra más potente que el GeForce III. Sin embargo en esta carrera aún estamos en la línea de salida y quedan muchos kilómetros para poder obtener un ganador. En el artículo he comentado cómo el primer Radeon entró en el mercado pasando por encima del chip de NVIDIA, en aquel entonces el GeForce II GTS, pero que las siguientes versiones PRO y Ultra de ese GeForce se mostraron más potentes que un Radeon que no evolucionó. Aunque el Radeon a base de unos controladores muy trabajados aumentó notablemente en rendimientos y seguía siendo el referente a la hora de hablar de calidad de imagen y reproducción DVD, los extraordinarios rendimientos de los nuevos chips de NVIDIA se lo pusieron muy difícil al chip de ATi...

Hoy día ATi entra en el mercado con su R200 y con una tarjeta, la Radeon 8500, con potencial suficiente para pasarle por encima a las GeForce III. De hecho las primeras pruebas así lo confirman. Sin embargo nos toca vivir otro de esos curiosos episodios que plagan un mercado tan 'sorpresivo' como es el del hardware: NVIDIA presenta sus Detonator 4. Y digo 'curioso episodio' porque no me dejan de sorprender las estrategias comerciales de estos gigantes que son capaces de retener un as en la manga hasta el momento justo de mostrar las cartas. Es sabido que los Detonator 4 llevan listos mucho tiempo. De hecho la prensa especializada cuenta con ellos desde hace semanas. Con estos nuevos controladores las GeForce III varían sensiblemente sus rendimientos, generalmente al alza. En 'clásicos' como Quake III la mejoría sobrepasa el 30%, si bien en otros juegos las diferencias no pasan del 10% o incluso llegan a no existir o ser negativas. El lanzamiento de los Detonator 4 en el mismo momento en que ATi presenta sus nuevas Radeon propicia que esta opción ya no sea tan interesante dado que las diferencias de rendimiento ya no son tan notables... Veremos cómo reacciona ATi, pero es muy previsible que el precio inicial de 399 dólares no tarde en bajar.

Y todo esto en cuanto al corto plazo. En el medio y el largo plazo habrá que ver, además de cómo se van moviendo los precios, cómo se van optimizando controladores aumentando rendimientos y logrando la ausencia total de problemas, y cómo se lanzan distintas revisiones del hardware basadas principalmente en un aumento de la frecuencia de los micros y memoria. Será entonces cuando la competencia entre los dos fabricantes empiece a ofrecer indicios de cuál será el triunfador en esta generación de tarjetas gráficas.

Otra batalla dentro de esta competencia se librará en el segmento medio y medio-bajo. Ahí es donde ATi introduce sus Radeon 7500 con el chip RV200. Aunque el precio de estas tarjetas pueda resultar atractivo, su futuro en cuanto aparezcan las inminentes GeForce III MX (las NV17), corre serio peligro. Independientemente del precio de la gama 'barata' de NVIDIA, sus chips pertenecerán a la presente generación de chips gráficos, mientras que el RV200 de ATi pertenece más bien a la anterior. Lo acertado sería comparar las 7500 con las GeForce II PRO, ya que ambas tarjetas ofrecen rendimientos y funciones muy similares.

En cuanto a las series All-in-Wonder y FIRE de ATi, nunca en la historia esas tarjetas habían contado con un corazón tan potente como es el Radeon II. A los usuarios de estas tarjetas poco hay que contarles además de que esta generación se tarjetas supone un grandísimo salto respecto a la anterior.