EHuanglu, director y experto en IA, asustado ante el avance de Seedance 2: “Esto puede borrar oficios enteros del cine”

Un creador alerta en X del salto cualitativo de un modelo capaz de generar escenas completas con audio y VFX, y señala riesgos creativos y legales.

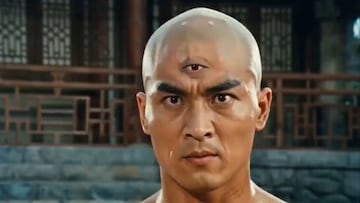

Hay un tipo de miedo en el sector audiovisualque no nace de una mala crítica, ni del presupuesto: nace de ver una herramienta hacer, en segundos, lo que antes era una cadena de manos, de oficios y de tiempos. Eso es, exactamente, lo que describe Ehuanglu (director y divulgador de herramientas de Inteligencia Artificial) en una publicación que se ha viralizado alrededor de Seedance 2.0, un modelo de generación de vídeo que, a su juicio, marca un antes y un después.

they made new jackie chan movie using seedance 2.0 .. ai has gone crazy

— el.cine (@EHuanglu) February 8, 2026

pic.twitter.com/yjzEqJxjFp https://t.co/HDyGaTDIjP

Varios vídeos bajo el modelo Seedance 2.0 se han popularizado en redes sociales, impresionando con el salto de calidad y atención al detalle (con sus fallos, pero el ritmo de crecimiento es mareante con respecto a lo que existía hace apenas unos meses). De entre ellos, destaca una escena de combate de Dragon Ball, ejecutada como si fuera una película de artes marciales de Hong Kong, que destaca además por la implementación del tercer ojo de Tenshinhan, mucho mejor conseguido que implementaciones parecidas en películas de grandes presupuestos,

Qué es Seedance 2.0

Seedance 2.0, creado por ByteDance y está ya asociado a Dreamina, la suite creativa de CapCut, con un énfasis llamativo en la entrada multimodal (texto, imágenes y clips como material de referencia) y en la coherencia de personajes a lo largo de varias tomas. En la propia descripción del servicio se habla de “consistencia” de personajes e IP, de transferencia de estilo y efectos, y de un uso explícito para previsualización en cine y videojuegos, justamente el terreno donde una escena “sirve” incluso cuando todavía no es la escena final.

El salto que describe Ehuanglu no está en la calidad aislada de una imagen, sino en el uso del lenguaje cinematográfico. Hablar de escenas implica continuidad, intención, ritmo y una mínima coherencia narrativa. Seedance 2.0 apunta precisamente a ese territorio: entradas multimodales (texto, imágenes, clips), consistencia de personajes a lo largo de varias tomas y capas de audio sincronizadas que convierten el resultado en algo más cercano a una secuencia montada que a un experimento visual.

El director y divulgador afirma además que hay funciones que “se sienten casi ilegales”, y pone un ejemplo especialmente inflamable: subir capturas o frames de storyboard de una película para generar escenas “que parecen del original”, aunque “distintas” e incluso “a veces mejores”. También habla de editar clips existentes “cambiando cualquier cosa” (personajes, fondo, efectos, gradación de color) como si el metraje fuese de quita y pon.

Se puede empezar a experimentar con el modelo en su página.

Noticias relacionadas

Sigue el canal de MeriStation en Twitter. Tu web de videojuegos y de entretenimiento, para conocer todas las noticias, novedades y última hora sobre el mundo del videojuego, cine, series, manga y anime. Avances, análisis, entrevistas, tráileres, gameplays, podcasts y mucho más.

¡Suscríbete! Si estás interesado en licenciar este contenido, pincha aquí.

Rellene su nombre y apellidos para comentar